Documente Academic

Documente Profesional

Documente Cultură

Unidad 2 Matrices

Încărcat de

CaArloss A. JiménezDrepturi de autor

Formate disponibile

Partajați acest document

Partajați sau inserați document

Vi se pare util acest document?

Este necorespunzător acest conținut?

Raportați acest documentDrepturi de autor:

Formate disponibile

Unidad 2 Matrices

Încărcat de

CaArloss A. JiménezDrepturi de autor:

Formate disponibile

Unidad 2 Matrices

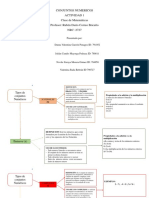

En esta unidad veremos varios tipos de matrices como la matriz cuadrada; que nos dice que se puede descomponer en la suma de una matriz simtrica y una matriz anti simtrica. Si A y B son matrices del mismo orden, entonces se pueden sumar entre s. Los productos de matrices son validos en ambos sentidos, AB y BA. Una matriz cuadrada A de orden N es singular si su determinante es nulo. En tal caso se dice que dicha matriz no tiene inversa. Continuando con las matrices, otra es la matriz rectangular: esta matriz tiene distinto nmero de filas de columnas, siendo su dimensin mxn. Un ejemplo de ello es lo siguiente:

Otra matriz es la diagonal: esta matriz est formada por ceros arriba y debajo de su diagonal. En la diagonal principal los nmeros no son todos ceros. Ejemplo:

Otra matriz es la de la identidad: esta matriz es una diagonal formado por unos en la diagonal principal. Esta se denota por In, donde n es el nmero de filas y de columnas de la matriz. La matriz identidad es la siguiente:

Continuando con matrices, otra es la matriz triangular superior: es una matriz cuadrada con ceros debajo de la diagonal principal y con nmeros no todos ceros arriba de dicha diagonal. Ejemplo:

Como ultima matriz tenemos la matriz triangular inferior: es una matriz cuadrada con ceros arriba de la diagonal principal y con nmeros no todos ceros abajo de dicha diagonal. Ejemplo:

Para calcular las matrices generalmente se utiliza el mtodo ms comn que es el de Gauss Jordn, usando la matriz identidad. Otro tema importante es el de cofactores de una matriz: Sea A una matriz de nxn, definimos los cofactores de A como: A1j= (-1)i+j (Mij) Para una matriz de nxn existen n2 cofactores de A.A la matriz de cofactores la llamamos por B, escrito por:

Adjunta de una matriz de nxn, definimos la adjunta de A (denotado por Adj A) como la traspuesta de la matriz cofactores de A, es decir: Adj A=B+ Teorema: si A es una matriz de nxn y la determinante de A es distinto de cero entonces la inversa de A existe y se calcula como:

A-1 = ___1____ Adj A \A\

Unidad 3 Sistemas de ecuaciones lineales

Ecuacin de la recta: Y=mx+b donde: m= pendiente; b= ordenada al origen.

Lo anterior es la forma generalizada de un sistema de ecuaciones lineales de m ecuaciones con n incgnitas. Un sistema de ecuaciones lineales, tambin conocido como sistema lineal de ecuaciones o simplemente sistema lineal, es un conjunto de ecuaciones lineales sobre un cuerpo o un anillo conmutativo. Un ejemplo de sistema lineal de ecuaciones sera el siguiente:

El problema consiste en encontrar los valores desconocidos de las variables x1, x2 y x3 que satisfacen las tres ecuaciones. El problema de los sistemas lineales de ecuaciones es uno de los ms antiguos de la matemtica y tiene una infinidad de aplicaciones, como en procesamiento digital de seales, anlisis estructural, estimacin, prediccin y ms generalmente en programacin lineal as como en la aproximacin de problemas no lineales de anlisis numrico.

La regla de Cramer es de importancia terica porque da una expresin explcita para la solucin del sistema. Sin embargo, para sistemas de ecuaciones lineales de ms de tres ecuaciones su aplicacin para la resolucin del mismo resulta excesivamente costosa: computacionalmente, es ineficiente para grandes matrices y por ello no es usado en aplicaciones prcticas que pueden implicar muchas ecuaciones. Sin embargo, como no es necesario pivotar matrices, es ms eficiente que la eliminacin gaussiana para matrices pequeas, particularmente cuando son usadas operaciones SIMD. Si es un sistema de ecuaciones. A es la matriz de coeficientes del sistema, es el vector columna de las incgnitas y es el vector columna de los trminos independientes. Entonces la solucin al sistema se presenta as:

Donde Aj es la matriz resultante de reemplazar la j-sima columna de A por el vector columna b. Hgase notar que para que el sistema sea compatible determinado, el determinante de la matriz A ha de ser no nulo.

Demostracin

Unidad 4 Espacios vectoriales

Un espacio vectorial V es un conjunto de objeto que tiene dos operaciones, la de suma y multiplicacin por un escalar.

Todo espacio vectorial V debe cumplir con las siguientes 10 propiedades: i. Si x V y y V, entonces x + y V (es decir, V es cerrado para la suma). ii. Para todos x, y, z en V, (x + y) + z = x + (y + z) (ley asociativa de la suma). iii. Existe un vector 0 V tal que para todo x V, x + 0 = 0 + x = x (0 se conoce como neutro aditivo). iv. Si x V, existe un vector -x en V tal que x + (-x) = 0 (-x se conoce como el inverso aditivo de x). v. Si x y y estn en V, entonces x + y = y + x (ley conmutativa de la suma de vectores). vi. Si x V, y es un escalar, entonces x V (se dice que V es cerrado para la multiplicacin escalar). vii. Si x y y estn en V y si es un escalar, entonces (x + y) = x + y (primera ley distributiva). viii. Si x V y si y son escalares, entonces ( y )x = x + x (segunda ley distributiva) ix. Si x y si y son escalares, entonces ()x = x (ley asociativa de la multiplicacin por escalar). x. Para todo vector x V, 1x = x (al escalar 1 se le conoce como neutro multiplicativo).

Subespacio Sea H un subconjunto de un espacio. Vectorial de V. decimos que H es un subespacio vectorial V si cumple las dos operaciones del espacio vectorial V, es decir, cumple con las dos propiedades de V. Teorema. Si H es un subespacio vectorial de V entonces H es en s misma un espacio vectorial de V. Teorema. Si H es un subespacio vectorial de V entonces cumple: i. Si x H y y H, entonces x + y H. ii. Si x H, entonces x H para todo escalar

Combinacin lineal. Sea V1, V2,,Vn vectores en un espacio vectorial V. Entonces cualquier vector lo podemos escribir como: C1V1 + C2V2+CnVn(1) Donde C1, C2,, Cn son escalares. La expresin (1) se llama combinacin lineal de V1, V2,,Vn.

Dependencia e independencia lineal.

Sea v1, v2, v3,, vn un conjunto de valores definidos en un espacio vectorial, se dice que estos vectores son linealmente dependiente (L.D) si existen escalares C1, C2,, Cn no todos ceros tales que C1V1 + C2V2++Cn= 0 Por el contrario si C1= C2 = C3=Cn=0 entonces el conjunto de vectores son linealmente independientes (L.D).

Bases y dimensin Sea V un espacio vectorial definimos la base de un espacio vectorial y si cumple como el conjunto de vectores {V1, V2, Vn} que cumple las siguientes condiciones: i. ii. {V1, V2,,Vn} son Li {v1, v2,, Vn} generalmente a todo el espacio vectorial V.

Teorema. Si {V1, V2,,Vn} forman una base para el espacio vectorial V, entonces la dimensin de V es el nmero de elementos de la base es decir; dim V = n

Unidad 5 Transformaciones lineales

Sea V y W espacios vectoriales reales. Una transformacin lineal T de V en W es una funcin que asigna a cada vector V E V un vector nico T (V) EW y que satisface, para cada U y V y cada escalar X, T (U+V) = T (U) + T (V)1 Y T( V) = T (V)..2

Teorema: sea V un espacio vectorial de dimensin finita con base B= {V1, V2,, Vn}. Sean {W1, W2,, Wn} n vectores en W. suponga que T, y T2 son dos transformaciones lineales de V en W tales que T1 (Vi) = T2 (Vi) = Wi, para i= 1,2,, n. entonces para cualquier vector V EV, T1 (V) = T2 (V); es decir T1 = T2. Teorema: sea V un espacio vectorial de dimensin finita con base B= {V1, V2,,Vn}. Sea W un espacio vectorial que contiene los vectores {W1, W W,, Wn}. Entonces existe una transformacin lineal nica T: V W tal que T (Vi) = Wi para i= 1, 2,, n

S-ar putea să vă placă și

- Monos y ListonesDocument8 paginiMonos y ListonesCaArloss A. JiménezÎncă nu există evaluări

- Historia Universal y ContemporaneaDocument6 paginiHistoria Universal y ContemporaneaCaArloss A. JiménezÎncă nu există evaluări

- Calcula y ColoreaDocument8 paginiCalcula y ColoreaCaArloss A. JiménezÎncă nu există evaluări

- Cifrassignificativas 22955Document3 paginiCifrassignificativas 22955Dany MárquezÎncă nu există evaluări

- Tecnica de Manejo de TransferenciaDocument3 paginiTecnica de Manejo de TransferenciaCaArloss A. JiménezÎncă nu există evaluări

- Hejm730208mtcrvn06 PDFDocument1 paginăHejm730208mtcrvn06 PDFCaArloss A. JiménezÎncă nu există evaluări

- Basura BiodegradableDocument8 paginiBasura BiodegradableCaArloss A. JiménezÎncă nu există evaluări

- Dimencionamiento de Equipos MinerosDocument8 paginiDimencionamiento de Equipos MinerosJuvenal TiconaÎncă nu există evaluări

- Tecnica de Manejo de TransferenciaDocument3 paginiTecnica de Manejo de TransferenciaCaArloss A. JiménezÎncă nu există evaluări

- Cuadernillo Silabas Señora WhatsapDocument36 paginiCuadernillo Silabas Señora WhatsapCaArloss A. JiménezÎncă nu există evaluări

- Notacion Exponencial PDFDocument12 paginiNotacion Exponencial PDFDeyvis AlfaroÎncă nu există evaluări

- Calculo Precio VentaDocument2 paginiCalculo Precio VentaCaArloss A. JiménezÎncă nu există evaluări

- Hejm730208mtcrvn06 PDFDocument1 paginăHejm730208mtcrvn06 PDFCaArloss A. JiménezÎncă nu există evaluări

- Hejm730208mtcrvn06 PDFDocument1 paginăHejm730208mtcrvn06 PDFCaArloss A. JiménezÎncă nu există evaluări

- PortadaDocument1 paginăPortadaCaArloss A. JiménezÎncă nu există evaluări

- Calculo Precio VentaDocument2 paginiCalculo Precio VentaCaArloss A. JiménezÎncă nu există evaluări

- Calculo Matemático de Los MedicamentosDocument1 paginăCalculo Matemático de Los MedicamentosCaArloss A. JiménezÎncă nu există evaluări

- Hejm730208mtcrvn06 PDFDocument1 paginăHejm730208mtcrvn06 PDFCaArloss A. JiménezÎncă nu există evaluări

- Ems 21 Habilidades Docentes PDFDocument22 paginiEms 21 Habilidades Docentes PDFguillermoÎncă nu există evaluări

- Guia de Estudio para FísicaDocument15 paginiGuia de Estudio para FísicaJesús Cisneros PradoÎncă nu există evaluări

- P-Aca-01-F-05 Formato de Evaluacion de ResidentesDocument2 paginiP-Aca-01-F-05 Formato de Evaluacion de ResidentesCaArloss A. Jiménez0% (1)

- Guia de Estudio para FísicaDocument15 paginiGuia de Estudio para FísicaJesús Cisneros PradoÎncă nu există evaluări

- Administración de La EnergiaDocument13 paginiAdministración de La Energiafriendlich_595718Încă nu există evaluări

- Predicado, complementos y adverbios en el análisis sintácticoDocument113 paginiPredicado, complementos y adverbios en el análisis sintácticoCaArloss A. JiménezÎncă nu există evaluări

- Reporte BimestralDocument1 paginăReporte BimestralCaArloss A. JiménezÎncă nu există evaluări

- Auditorias Energéticas Edificios I WebDocument204 paginiAuditorias Energéticas Edificios I Webprofama_documents100% (3)

- Solicitud de Opcion de Titulacion (Competencias)Document1 paginăSolicitud de Opcion de Titulacion (Competencias)CaArloss A. JiménezÎncă nu există evaluări

- PortadaDocument1 paginăPortadaCaArloss A. JiménezÎncă nu există evaluări

- Sistemas de Frenos en AutomóvilesDocument8 paginiSistemas de Frenos en AutomóvilesCaArloss A. JiménezÎncă nu există evaluări

- Investigación DocumentalDocument14 paginiInvestigación DocumentalCaArloss A. JiménezÎncă nu există evaluări

- 1.5 Ecuaciòn Del PlanoDocument6 pagini1.5 Ecuaciòn Del PlanoJonathan NolascoÎncă nu există evaluări

- 4.2 Funcion LogaritmicaDocument43 pagini4.2 Funcion LogaritmicaJosé De La O MejiaÎncă nu există evaluări

- 4.3ecuacion Diferencial para Viga-ColumnaDocument4 pagini4.3ecuacion Diferencial para Viga-Columnavictor luis100% (1)

- 497 - Tarea 3 - Andrea GomezDocument9 pagini497 - Tarea 3 - Andrea GomezAndrea GomezÎncă nu există evaluări

- Ecuaciones Diferencial InexactaDocument11 paginiEcuaciones Diferencial InexactaJohan Daniel Masgo NarcizoÎncă nu există evaluări

- Actividades 1 y 2 Evaluativas PDF Fundamentos de MatematicasDocument14 paginiActividades 1 y 2 Evaluativas PDF Fundamentos de MatematicasJulian Camilo Mayorga PedrazaÎncă nu există evaluări

- Examenes Pasados Prefa Estudiantes2do Parcial-2Document15 paginiExamenes Pasados Prefa Estudiantes2do Parcial-2Alexander Toro Torrez0% (1)

- Solucionario Álgebra Lineal (Libro)Document76 paginiSolucionario Álgebra Lineal (Libro)Daniel Fernando Alfonso Díaz50% (28)

- Función HolomorfaDocument2 paginiFunción HolomorfaSantiago AristizábalÎncă nu există evaluări

- Diseño y ProporcionDocument52 paginiDiseño y ProporcionAdrian LPÎncă nu există evaluări

- Números primos y compuestos: definiciones y propiedadesDocument3 paginiNúmeros primos y compuestos: definiciones y propiedadesBertha Sixtina Mendoza VargasÎncă nu există evaluări

- MatricesDocument11 paginiMatricesRafa MolinaÎncă nu există evaluări

- Área de Una Región Plana Bajo Cualquier CurvaDocument8 paginiÁrea de Una Región Plana Bajo Cualquier CurvaBriana Flores Flores100% (1)

- Material de Clase 1.2 RespuestasDocument2 paginiMaterial de Clase 1.2 RespuestasRichard MamaniÎncă nu există evaluări

- Calculo I - Ingeniería Mecánica - UC3 - Funciones Elementales y LímitesDocument3 paginiCalculo I - Ingeniería Mecánica - UC3 - Funciones Elementales y LímitesJosé Manuel Sánchez100% (2)

- Programa de Mejoramiento Guía 07 Factorizacion MathtypeDocument13 paginiPrograma de Mejoramiento Guía 07 Factorizacion Mathtypecvcarlosvilla1Încă nu există evaluări

- Guia de Matematicas Actualizada-1Document19 paginiGuia de Matematicas Actualizada-1Martin GonzálezzÎncă nu există evaluări

- Sistema DiedricoDocument58 paginiSistema DiedricoMarco MonteroÎncă nu există evaluări

- CURSO: 3° ECO Espacio Disciplinar: MATEMATICA Profesor/a: MELISA POLLADocument1 paginăCURSO: 3° ECO Espacio Disciplinar: MATEMATICA Profesor/a: MELISA POLLAMilton riojaÎncă nu există evaluări

- Clase 4Document10 paginiClase 4Jhosep Benjamin Calisaya FloresÎncă nu există evaluări

- Sig 2016 A 02 PDFDocument12 paginiSig 2016 A 02 PDFEdwar SalazarÎncă nu există evaluări

- Multiplicación de MatricesDocument13 paginiMultiplicación de MatricesshirleynarÎncă nu există evaluări

- Sistemas de coordenadas geométricasDocument5 paginiSistemas de coordenadas geométricasWILBER CUTIMBO CHOQUEÎncă nu există evaluări

- GUIA CONICAS Todos Los TemasDocument6 paginiGUIA CONICAS Todos Los TemasPablo BarahonaÎncă nu există evaluări

- Equilibrio en el Plano y en el EspacioDocument11 paginiEquilibrio en el Plano y en el EspacioMERYLIN CRISTINA ORTEGA ORTEGAÎncă nu există evaluări

- MAT-315 Revi PDFDocument2 paginiMAT-315 Revi PDFJohn Peter Sosa GutierrezÎncă nu există evaluări

- HTEORIA. Semana5-Ecuaciones e Inec - Maximo EnteroDocument5 paginiHTEORIA. Semana5-Ecuaciones e Inec - Maximo EnteroMili Cutipa100% (1)

- Investigación Matrices Semejantes y DiagonalizaciónDocument5 paginiInvestigación Matrices Semejantes y DiagonalizaciónFeernanda C. CalderonÎncă nu există evaluări

- Regla de Tres Simple y Compuesta Ejercicios Resueltos PDFDocument1 paginăRegla de Tres Simple y Compuesta Ejercicios Resueltos PDFMestreLouÎncă nu există evaluări

- PHP Buen Ejemplo SimplexDocument8 paginiPHP Buen Ejemplo Simplexcolono500Încă nu există evaluări