Documente Academic

Documente Profesional

Documente Cultură

Funciones Generadoras

Încărcat de

AMYNNXXXXDrepturi de autor

Formate disponibile

Partajați acest document

Partajați sau inserați document

Vi se pare util acest document?

Este necorespunzător acest conținut?

Raportați acest documentDrepturi de autor:

Formate disponibile

Funciones Generadoras

Încărcat de

AMYNNXXXXDrepturi de autor:

Formate disponibile

w

w

w

.

.

c

o

m

M

a

t

e

m

a

t

i

c

a

1

Cap

tulo 8

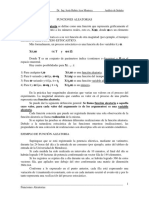

Funciones generadoras

En este captulo se estudia la funcion generadora de probabilidad, la funcion

generadora de momentos y la funcion caracterstica. Estas funciones son

transformaciones de las distribuciones de probabilidad, y constituyen una

herramienta muy util en la teora moderna de la probabilidad.

8.1. Funcion generadora de probabilidad

Definici

on. (Funci

on generadora de probabilidad). La funcion

generadora de probabilidad de una variable aleatoria X es la funcion

G(t) = E(t

X

),

denida para valores reales de t tal que la esperanza sea convergente

absolutamente.

Cuando sea necesario especicarlo se escribe G

X

(t) en lugar de G(t), y se

usan las letras f.g.p. en lugar de funcion generadora de probabilidad. Es-

ta funcion se utiliza principalmente, aunque no unicamente, para variables

311

www.cienciamatematica.com

w

w

w

.

.

c

o

m

M

a

t

e

m

a

t

i

c

a

1

312 8.1. Funci

on generadora de probabilidad

aleatorias con valores enteros. Supondremos tal caso y sin perdida de ge-

neralidad consideraremos que las variables toman valores en el conjunto

{0, 1, . . .}, que corresponde a la mayora de las variables aleatorias discretas

estudiadas en este curso. En tal situacion,

G(t) =

k=0

t

k

P(X = k).

Es decir, la f.g.p. es una serie de potencias en t, con coecientes dados por

la distribucion de probabilidad, por ende el nombre de dicha funcion. Es

importante observar que el radio de convergencia de esta serie es por lo

menos uno, pues para |t| < 1,

|G(t)|

k=0

|t|

k

P(X = k)

k=0

P(X = k) = 1.

Calculando la k-esima derivada puede comprobarse ademas que a partir de

la f.g.p. puede reconstruirse la funcion de densidad a traves de la formula

P(X = k) = G

(k)

(0)/k!

Ejemplo. Sea X con distribucion Poisson(). La f.g.p. de X esta denida

para todo valor real de t y puede calcularse de la siguiente forma.

G(t) =

k=0

t

k

e

k

k!

= e

k=0

(t)

k

k!

= e

e

t

= e

(1t)

.

En la siguiente tabla se muestran ejemplos de funciones generadoras de

probabilidad para algunas distribuciones discretas.

www.cienciamatematica.com

w

w

w

.

.

c

o

m

M

a

t

e

m

a

t

i

c

a

1

Cap

tulo 8. Funciones generadoras 313

Distribuci

on Funci

on generadora de probabilidad

unif{x

1

, . . . , x

n

} G(t) = (t

x

1

+ +t

x

n

)/n

Ber(p) G(t) = 1 p +pt

bin(n, p) G(t) = (1 p +pt)

n

geo(p) G(t) = p/[1 t(1 p)]

Poisson()

G(t) = e

(1t)

bin neg(r, p) G(t) = (p/[1 t(1 p)])

r

La funcion generadora de probabilidad determina de manera unica a la

distribucion en el siguiente sentido. Si X y Y tienen la misma distribucion

de probabilidad, entonces naturalmente G

X

(t) = G

Y

(t), para valores de t

donde esta esperanza exista. Inversamente, sean X y Y tales que G

X

(t) y

G

Y

(t) existen y coinciden en alg un intervalo no trivial alrededor del cero,

entonces X y Y tienen la misma distribucion. Estas y otras propiedades

generales de la f.g.p. se estudian a continuacion, mas adelante se ilustran

estos resultados con algunos ejemplos.

www.cienciamatematica.com

w

w

w

.

.

c

o

m

M

a

t

e

m

a

t

i

c

a

1

314 8.1. Funci

on generadora de probabilidad

Proposici

on. (Propiedades de la f.g.p.).

1. Sean X y Y variables aleatorias con valores en {0, 1, . . .} tales que

G

X

(t) y G

Y

(t) existen y coinciden en alg un intervalo alrededor de

t = 0. Entonces X y Y tienen la misma distribucion de probabili-

dad.

2. Si el n-esimo momento factorial de X existe, entonces

lm

t1

d

n

dt

n

G

X

(t) = E[X(X 1) (X n + 1)].

3. Sean X y Y independientes con f.g.p. G

X

(t) y G

Y

(t) respectiva-

mente, entonces G

X+Y

(t) = G

X

(t) G

Y

(t).

Demostracion.

1. Para cada k 0, sean a

k

= P(X = k) y b

k

= P(Y = k). La igualdad

G

X

(t) = G

Y

(t) se escribe de la forma:

k=0

t

k

a

k

=

k=0

t

k

b

k

.

Para que estas dos series de potencias en t coincidan en alg un inter-

valo no trivial alrededor del cero, sus coecientes deben forzosamente

coincidir, es decir, a

k

= b

k

para cada k 0. Esto signica que las

distribuciones de probabilidad coinciden.

2. Como las series de potencia se pueden derivar termino a termino con-

www.cienciamatematica.com

w

w

w

.

.

c

o

m

M

a

t

e

m

a

t

i

c

a

1

Cap

tulo 8. Funciones generadoras 315

servandose el mismo radio de convergencia, se tiene que

G

(t) =

d

dt

k=0

t

k

P(X = k)

=

k=0

d

dt

t

k

P(X = k)

=

k=1

k t

k1

P(X = k).

Como por hipotesis la esperanza existe, por el lema de Abel (ver

apendice),

lm

t1

G

(t) =

k=1

kP(X = k) = E(X).

Para la segunda derivada se tiene

G

(t) =

k=2

k(k 1)t

k2

P(X = k),

de modo que cuando el segundo momento existe,

lm

t1

G

(t) =

k=2

k(k 1)P(X = k) = E(X(X 1)).

De manera analoga se demuestra para las derivadas de orden superior.

3. Cuando X y Y son independientes,

G

X+Y

(t) = E(t

X+Y

) = E(t

X

t

Y

) = E(t

X

) E(t

Y

) = G

X

(t) G

Y

(t).

Ejemplo. Se ha encontrado que la f.g.p. de una variable aleatoria X con

distribucion Poisson() es G(t) = e

(1t)

. Usando esta funcion encontra-

remos la esperanza y varianza de X. Al derivar una vez se obtiene G

(t) =

www.cienciamatematica.com

w

w

w

.

.

c

o

m

M

a

t

e

m

a

t

i

c

a

1

316 8.2. Funci

on generadora de momentos

e

(1t)

, y al evaluar en t = 1, E(X) = G

(1) = . Derivando por segunda

vez, G

(t) =

2

e

(1t)

, y en t = 1 se obtiene E(X(X 1)) = G

(1) =

2

.

Por lo tanto Var(X) = E(X

2

) E

2

(X) =

2

+

2

= .

Debido a la segunda propiedad, a la f.g.p. tambien se le conoce como funcion

generadora de momentos factoriales. Ahora se muestra el uso de esta funcion

para determinar la distribucion de una variable aleatoria, el procedimiento

es elegante y sencillo.

Ejemplo. Suponga que X y Y son independientes con distribucion Poisson(

1

)

y Poisson(

2

), respectivamente. Entonces

G

X+Y

(t) = G

X

(t) G

Y

(t) = e

1

(1t)

e

2

(1t)

= e

(

1

+

2

)(1t)

.

Esta expresion corresponde a la f.g.p. de la distribucion Poisson con parame-

tro

1

+

2

. Debido a la unicidad, X+Y tiene distribucion Poisson(

1

+

2

).

La denicion de funcion generadora de probabilidad puede extenderse al

caso de vectores aleatorios de la siguiente forma. La f.g.p. del vector (X, Y )

es la funcion G

X,Y

(s, t) = E(s

X

t

Y

), para valores reales de s y t donde

esta esperanza sea absolutamente convergente. Puede demostrarse que las

variables X y Y son independientes si, y solo si, G

X,Y

(s, t) = G

X

(s) G

Y

(t).

La denicion de f.g.p. para vectores de dimension mayor es analoga.

8.2. Funcion generadora de momentos

Esta es otra funcion que se puede asociar a algunas distribuciones de pro-

babilidad. Su existencia no esta garantizada en todos los casos, pero cuando

existe, determina de manera unica a la distribucion de probabilidad asocia-

da, y tiene propiedades semejantes a las de la funcion generadora de proba-

bilidad. La funcion generadora de momentos se utiliza tanto para variables

aleatorias discretas como continuas.

www.cienciamatematica.com

w

w

w

.

.

c

o

m

M

a

t

e

m

a

t

i

c

a

1

Cap

tulo 8. Funciones generadoras 317

Definici

on. (Funci

on generadora de momentos). La funcion ge-

neradora de momentos de la variable aleatoria X es la funcion

M(t) = E(e

tX

),

denida para valores reales de t tales que la esperanza es absolutamente

convergente.

Nuevamente, cuando sea necesario especicarlo se escribe M

X

(t) en lugar

de M(t), y se usan las letras f.g.m. en lugar del termino funcion generadora

de momentos. La parte importante de esta funcion es su existencia en una

vecindad no trivial alrededor del cero. Observe que la f.g.m. y la f.g.p. estan

relacionadas, cuando existen, por la igualdad M(t) = G(e

t

).

Ejemplo. Sea X con distribucion gama(n, ). Entonces la f.g.m. de X puede

calcularse de la siguiente forma.

M(t) =

_

0

e

tx

(x)

n1

(n)

e

x

dx

=

n

( t)

n

_

0

[( t)x]

n1

(n)

( t)e

(t)x

dx

= [/( t)]

n

.

La ultima integral vale uno pues el integrando es la funcion de densidad

de una distribucion gama. Observe que M(t) esta denida unicamente para

valores de t menores que .

La siguiente tabla muestra algunos otros ejemplos de funciones generadoras

de momentos para ciertas distribuciones continuas.

www.cienciamatematica.com

w

w

w

.

.

c

o

m

M

a

t

e

m

a

t

i

c

a

1

318 8.2. Funci

on generadora de momentos

Distribuci

on Funci

on generadora de momentos

unif(a, b) M(t) = (e

bt

e

at

)/(bt at)

exp() M(t) = /( t)

gama(n, ) M(t) = [/( t)]

n

N(,

2

) M(t) = exp(t +

2

t

2

/2)

2

(n) M(t) = (1 2t)

n/2

t(n) M(t) no existe para t = 0

Se demuestran a continuacion algunas propiedades basicas de la f.g.m., y

despues se muestra su utilidad mediante algunos ejemplos.

Proposici

on. Sea X con f.g.m. M(t) nita para cada t (s, s), para

alg un s > 0. Entonces

1. Todos los momentos de X son nitos.

2. M(t) =

n=0

t

n

n!

E(X

n

).

3. M(t) tiene derivadas continuas de cualquier orden en (s, s), y se

cumple

d

n

dt

n

M(t)

t=0

= E(X

n

).

Demostracion.

www.cienciamatematica.com

w

w

w

.

.

c

o

m

M

a

t

e

m

a

t

i

c

a

1

Cap

tulo 8. Funciones generadoras 319

1. La prueba se basa en las identidades:

E |X|

n

= n

_

0

(1 F(x)) x

n1

dx +n

_

0

F(x) |x|

n1

dx,

y M(t) = 1 +t

_

0

(1 F(x)) e

tx

dx t

_

0

F(x) e

tx

dx,

en donde, por hipotesis, las dos integrales de M(t) son nitas para

cualquier t (s, s). Demostraremos que cada integral de la expresion

de E|X|

n

es menor o igual a la correspondiente integral de M(t). Para

el caso x > 0 se toma cualquier t (0, s), y entonces

(tx)

n

n!

e

tx

.

Es decir, x

n

(n!/t

n

)e

tx

. De modo que, salvo constantes, la primera

integral de E|X|

n

es menor o igual a la primera integral de M(t),

siendo esta ultima nita, la primera tambien. Para el caso x < 0

conviene tomar t (s, 0), pues en tal caso tx > 0 y entonces

|tx|

n

n!

e

|tx|

= e

tx

.

Es decir, |x|

n

(n!/|t|

n

)e

tx

. Ahora la segunda integral de E|X|

n

es

menor o igual a la segunda integral de M(t), siendo esta ultima nita,

la primera tambien. De esta forma todos los momentos de X existen

cuando M(t) es nita en alg un intervalo no trivial alrededor del cero.

2. Se usa la formula

E(X

n

) = n

_

0

(1 F(x)) x

n1

dx n

_

0

F(x) x

n1

dx.

www.cienciamatematica.com

w

w

w

.

.

c

o

m

M

a

t

e

m

a

t

i

c

a

1

320 8.2. Funci

on generadora de momentos

Entonces para cualquier t (s, s), y m 1,

m

n=0

t

n

n!

E(X

n

) = 1 +

m

n=1

t

n

n!

n

_

0

(1 F(x)) x

n1

dx

n=1

t

n

n!

n

_

0

F(x) x

n1

dx

= 1 +t

_

0

(1 F(x))

m1

n=0

t

n

n!

x

n

dx

t

_

0

F(x)

m1

n=0

t

n

n!

x

n

dx.

Usando el teorema de convergencia monotona, o el de convergencia

dominada, dependiendo de los valores de t y x, cada una de estas

integrales es convergente, para cualquier t (s, s), cuando se hace

m tender a innito. De modo que

n=0

t

n

n!

E(X

n

) = 1 +t

_

0

(1 F(x)) e

tx

dx t

_

0

F(x) e

tx

dx

= M(t).

3. Dado que M(t) se puede expresar como una serie de potencias en t,

diferenciando y evaluando en cero se obtienen los coecientes E(X

n

).

Nota importante. El hecho de que el n-esimo momento de una variable

aleatoria exista, no implica que este puede ser hallado a traves de la n-

esima derivada de la f.g.m. evaluada en cero. Es decir, es necesario conocer

la existencia de la f.g.m. para que pueda ser utilizada para obtener los

momentos. Por ejemplo, una variable aleatoria con distribucion t(n) tiene

esperanza cero pero su f.g.m. M(t) no existe para t distinto de cero.

www.cienciamatematica.com

w

w

w

.

.

c

o

m

M

a

t

e

m

a

t

i

c

a

1

Cap

tulo 8. Funciones generadoras 321

Ejemplo. Sea X con distribucion gama(n, ). Hemos encontrado antes que

para t < , M(t) =

n

(t)

n

. Calcularemos ahora la esperanza y varianza

de X con ayuda de la f.g.m. Derivando una vez, M

(t) =

n

n(t)

n1

. Al

evaluar en t = 0 se obtiene E(X) = n/. Derivando nuevamente, M

(t) =

n

n(n+1)(t)

n2

. Por lo tanto E(X

2

) = M

(0) = n(n+1)/

2

. Entonces

Var(X) = n(n + 1)/

2

n

2

/

2

= n/

2

.

Ejemplo. Suponga ahora que X y Y son independientes cada una con

distribucion gama(n, ) y gama(m, ), respectivamente. Entonces la f.g.m.

de X +Y es

M

X+Y

(t) = M

X

(t) M

Y

(t) =

n

( t)

n

m

( t)

m

=

n+m

( t)

nm

.

Esta es la expresion de la f.g.m. de la distribucion gama, ahora con parame-

tros n+my . Se concluye entonces X+Y tiene distribucion gama(n+m, ).

Nuevamente, es sencillo demostrar que la funcion generadora de la suma

de dos variables aleatorias independientes es el producto de las funciones

generadoras individuales.

Proposici

on. Sean X y Y son independientes, y cuyas f.g.m. existen

en una vecindad no trivial alrededor del cero. Entonces para cualquier

t (s, s) para alg un s > 0,

M

X+Y

(t) = M

X

(t) M

Y

(t).

Demostracion.

M

X+Y

(t) = E(e

t(X+Y )

) = E(e

tX

e

tY

) = E(e

tX

) E(e

tY

) = M

X

(t) M

Y

(t).

www.cienciamatematica.com

w

w

w

.

.

c

o

m

M

a

t

e

m

a

t

i

c

a

1

322 8.2. Funci

on generadora de momentos

Es interesante observar que la condicion M

X+Y

(t) = M

X

(t) M

Y

(t) no es

suciente para concluir que X y Y son independientes.

Ejercicio. Sea (X, Y ) un vector aleatorio con funcion de densidad

f(x, y) = [1 +xy(x

2

y

2

)]/4, para 1 < x, y < 1.

Demuestre que X y Y no son independientes y sin embargo se cumple la

identidad M

X+Y

(t) = M

X

(t) M

Y

(t).

Como hemos mencionado antes, no todas las distribuciones de probabilidad

permiten calcular la funcion generadora de momentos dentro de un intervalo

no trivial alrededor del cero, ni todos los calculos son tan sencillos como en el

ejemplo mostrado. Por ejemplo, la f.g.m. de la distribucion Cauchy estandar

no existe para valores de t distintos de cero, esto se pide comprobar en el

ejercicio 575. Por otro lado, cuando se tienen dos variables X y Y con la mis-

ma distribucion, entonces sus funciones generadoras de momentos coinciden

pues estas de obtienen a traves de la funcion de distribucion com un. Por el

contrario, si M

X

(t) = M

Y

(t) en una vecindad no trivial alrededor del cero,

entonces puede demostrarse que sus distribuciones coinciden, este resultado

y otro relativo a convergencia es el contenido de la siguiente proposicion,

cuya demostracion omitiremos.

Proposici

on.

1. (Unicidad). Las variables X y Y tienen la misma distribucion si,

y solo si, M

X

(t) = M

Y

(t) para valores de t en una vecindad no

trivial alrededor del cero.

2. (Continuidad). Sea X

1

, X

2

, . . . una sucesion de variables aleato-

rias cuyas funciones generadoras de momentos existen todas ellas

en alg un intervalo no trivial alrededor del cero. Sea X con f.g.m.

M

X

(t). Entonces X

n

d

X si, y solo si, M

X

n

(t) M

X

(t).

Para el caso de vectores aleatorios se tiene la siguiente denicion. La fun-

www.cienciamatematica.com

w

w

w

.

.

c

o

m

M

a

t

e

m

a

t

i

c

a

1

Cap

tulo 8. Funciones generadoras 323

ci on generadora de momentos del vector (X, Y ) es la funcion M

X,Y

(s, t) =

E(e

sX

e

tY

), para valores reales de s y t donde esta esperanza sea absoluta-

mente convergente. Puede demostrarse que las variables X y Y son inde-

pendientes si, y solo si, M

X,Y

(s, t) = M

X

(s) M

Y

(t). La denicion de f.g.m.

para vectores de dimension mayor es analoga.

En la seccion de ejercicios se pueden encontrar las funciones generadoras de

momentos de algunas otras distribuciones de probabilidad, tanto discretas

como continuas, as como en el primer apendice al nal del libro.

8.3. Funcion caracterstica

Esta es una funcion denida para cada distribucion de probabilidad, y a

diferencia de las funciones generadoras de probabilidad y de momentos es-

tudiadas antes, siempre existe.

Definici

on. (Funci

on caracter

stica). La funcion caracterstica de

la variable aleatoria X es la funcion

(t) = E

_

e

itX

_

,

denida para cualquier n umero real t. El n umero i es la unidad de los

n umeros imaginarios.

Observe que la transformacion X e

itX

lleva una variable aleatoria real X

a una variable aleatoria con valores en los n umeros complejos de la forma

cos(tX) + i sen(tX), en donde cada parte de este n umero complejo es una

variable aleatoria real, es decir, se trata de un vector aleatorio bidimensional

como los estudiados anteriormente. La funcion caracterstica puede entonces

escribirse en la forma

(t) = E(cos tX) +i E(sen tX).

Nuevamente se escribe

X

(t) cuando sea necesario especicar que se trata de

www.cienciamatematica.com

w

w

w

.

.

c

o

m

M

a

t

e

m

a

t

i

c

a

1

324 8.3. Funci

on caracter

stica

la funcion caracterstica de X, y se escribe simplemente f.c. en lugar de fun-

cion caracterstica. Observe que la f.c., la f.g.m. y la f.g.p. estan relacionadas,

cuando existen las dos ultimas, por las igualdades (t) = M(it) = G(e

it

).

Se muestran a continuacion algunos ejemplos de la forma de encontrar la

funcion caracterstica a partir de una distribucion de probabilidad.

Ejemplo. Sea X con distribucion bin(n, p). Entonces

(t) = E(e

itX

)

=

n

x=0

e

itx

_

n

x

_

p

x

(1 p)

nx

=

n

x=0

_

n

x

_

(pe

it

)

x

(1 p)

nx

= (1 p +pe

it

)

n

.

Ejemplo. Sea X con distribucion Poisson(). Entonces

(t) = E(e

itX

)

=

x=0

e

itx

e

x

x!

= e

x=0

(e

it

)

x

x!

= e

(1e

it

)

.

Otros ejemplos de funciones caractersticas de distribuciones discretas se

muestra en la siguiente tabla. El lector puede comprobar cada una de estas

expresiones.

www.cienciamatematica.com

w

w

w

.

.

c

o

m

M

a

t

e

m

a

t

i

c

a

1

Cap

tulo 8. Funciones generadoras 325

Distribuci

on Funci

on caracter

stica

Ber(p) (t) = 1 p +pe

it

bin(n, p) (t) = (1 p +pe

it

)

n

Poisson()

(t) = e

(1e

it

)

geo(p) (t) = p/(1 (1 p)e

it

)

bin neg(r, p) (t) = [p/(1 (1 p)e

it

)]

r

Ahora se mostrara la forma de encontrar la funcion caracterstica para dos

distribuciones continuas: la distribucion normal y la distribucion gama.

Ejemplo. Sea X con distribucion N(,

2

). Entonces

(t) = E(e

itX

)

=

_

e

itx

1

2

2

e

(x)

2

/2

2

dx

=

_

2

2

e

(x

2

2x(it

2

)+

2

)/2

2

dx

= e

(

2

+(it

2

)

2

)/2

2

_

2

2

e

[x(it

2

)]

2

/2

2

dx

= e

itt

2

2

/2

.

Observe que el ultimo integrando es la funcion de densidad normal con media

el n umero complejo it

2

, y varianza

2

. El hecho de que esta integral

tambien vale uno puede comprobarse, por ejemplo, usando el principio de

www.cienciamatematica.com

w

w

w

.

.

c

o

m

M

a

t

e

m

a

t

i

c

a

1

326 8.3. Funci

on caracter

stica

continuacion analtica de la teora de variable compleja.

Ejemplo. Sea X con distribucion gama(n, ). Entonces

(t) = E(e

itX

)

=

_

0

e

itx

(x)

n1

(n)

e

x

dx

=

_

0

(n)

(x)

n1

e

(it)x

dx

=

n

( it)

n

_

0

[( it)x]

n1

(n)

( it) e

(it)x

dx

= (

it

)

n

.

El ultimo integrando es la funcion de densidad de la distribucion gama(n,

it). Nuevamente usando la teora de variable compleja puede demostrarse

rigurosamente que esta integral tambien vale uno.

La siguiente tabla muestra algunos otros ejemplos de funciones caractersti-

cas para variables aleatorias continuas.

Distribuci

on Funci

on caracter

stica

unif(a, b) (t) = (e

ibt

e

iat

)/(ibt iat)

exp() (t) = /( it)

gama(n, ) (t) = [/( it)]

n

N(,

2

) (t) = exp(it

2

t

2

/2)

2

(n) (t) = (1 2it)

n/2

t(n)

(t) = e

|t|

, cuando n = 1.

www.cienciamatematica.com

w

w

w

.

.

c

o

m

M

a

t

e

m

a

t

i

c

a

1

Cap

tulo 8. Funciones generadoras 327

La existencia de la funcion caracterstica para cualquier distribucion de

probabilidad se sigue del siguiente resultado.

Proposici

on. (Existencia). Para cualquier n umero real t, |(t)| 1.

En particular, (0) = 1.

Demostracion. Para cualquier n umero real t,

|(t)| = |

_

e

itx

dF(x)|

_

|e

itx

| dF(x) =

_

dF(x) = 1.

De modo que (t) es un n umero complejo de modulo menor o igual a uno,

para cualquier valor de t. Veremos a continuacion algunas otras propiedades

de esta importante funcion. En particular, demostraremos que los momentos

de una variable aleatoria X pueden ser generados, cuando existen, con la f.c.

a traves de la formula

(n)

(0) = i

n

E(X

n

), y como en el caso de las funciones

generadoras anteriores, cuando X y Y son independientes se cumple que

X+Y

(t) =

X

(t)

Y

(t), no siendo valido en general el recproco.

Proposici

on. Si X tiene n-esimo momento nito, entonces

1.

d

n

dt

n

(t)

t=0

= i

n

E(X

n

).

2. Cuando t 0,

(t) =

n1

k=0

(it)

k

k!

E(X

k

) +

(it)

n

n!

( E(X

n

) +o(1) ). (8.1)

Demostracion.

www.cienciamatematica.com

w

w

w

.

.

c

o

m

M

a

t

e

m

a

t

i

c

a

1

328 8.3. Funci

on caracter

stica

1. Para cualquier h distinto de cero,

(t +h) (t)

h

=

_

e

i(t+h)x

e

itx

h

dF(x)

=

_

e

itx

e

ihx

1

h

dF(x)

= E( e

itX

e

ihX

1

h

). (8.2)

Como lm

h0

e

ihx

1

h

= ix, entonces, puntualmente,

lm

h0

e

itX

e

ihX

1

h

= iX e

itX

.

Comprobaremos que las variables aleatorias de esta sucesion, parame-

trizada por h, estan uniformemente acotadas por una variable aleato-

ria integrable, en efecto,

|e

itX

e

ihX

1

h

| = |

e

ihX

1

h

|

= |

1

h

_

h

0

iX e

isX

ds|

|X|

1

h

_

h

0

|e

isX

| ds

= |X|.

Por hipotesis, E|X| < , de modo que usando el teorema de conver-

gencia dominada en (8.2) se obtiene

d

dt

(t) = E[ iX e

itX

].

Por el mismo procedimiento se encuentra que

d

n

dt

n

(t) = E[ (iX)

n

e

itX

].

www.cienciamatematica.com

w

w

w

.

.

c

o

m

M

a

t

e

m

a

t

i

c

a

1

Cap

tulo 8. Funciones generadoras 329

Tomando el lmite cuando t 0 y usando nuevamente el teorema de

convergencia dominada, se demuestra nalmente que

d

n

dt

n

(t)

t=0

= i

n

E(X

n

).

2. La formula se sigue del inciso anterior y del siguiente resultado de

analisis. Si g es una funcion con valores reales o complejos y denida

en alg un intervalo no trivial alrededor del origen con g

(n)

(0) nita,

entonces cuando t 0,

g(t) = g(0)+tg

(0)+

t

2

2!

g

(0)+ +

t

n1

(n 1)!

g

(n1)

(0)+

t

n

n!

( g

(n)

(0)+o(1) ).

En la ultima parte del curso se usara la expansion (8.1) para demostrar la

ley de los grandes n umeros y el teorema del lmite central. Para el primer

resultado se supondra el primer momento nito y la expansi on adquiere la

expresion (t) = 1 + it( E(X) + o(1) ), cuando t 0. Para el teorema del

lmite central se supondra el segundo momento nito y la expresion que se

usa es (t) = 1 +it E(X) + ((it)

2

/2!)( E(X

2

) +o(1) ), cuando t 0.

Proposici

on. Si X y Y son independientes, entonces

X+Y

(t) =

X

(t)

Y

(t).

Demostracion. Por independencia,

X+Y

(t) = E(e

it(X+Y )

) = E(e

itX

e

itY

) = E(e

itX

) E(e

itY

) =

X

(t)

Y

(t).

Nota importante. El resultado anterior establece en particular que el

producto de dos funciones caractersticas es nuevamente una funcion carac-

terstica. Por otro lado, es necesario se nalar que la condicion

X+Y

(t) =

www.cienciamatematica.com

w

w

w

.

.

c

o

m

M

a

t

e

m

a

t

i

c

a

1

330 8.3. Funci

on caracter

stica

X

(t)

Y

(t) no es suciente para concluir que las variables aleatorias X y

Y son independientes.

Ejercicio. Sea (X, Y ) un vector aleatorio con funcion de densidad

f(x, y) = [1 +xy(x

2

y

2

)]/4, para 1 < x, y < 1.

Demuestre que X y Y no son independientes y sin embargo se cumple la

identidad

X+Y

(t) =

X

(t)

Y

(t).

Otra de las propiedades fundamentales de la funcion caracterstica es su ca-

pacidad de determinar de manera unica a las distribuciones de probabilidad.

A este respecto se tienen los siguientes resultados.

Proposici

on. (F

ormula de inversi

on de L

`

evy). Sea X con funcion

de distribucion F(x), y funcion caracterstica (t). Si x < y son puntos

de continuidad de F, entonces

F(y) F(x) = lm

T

1

2

_

T

T

e

itx

e

ity

it

(t) dt.

Cuando x y y no necesariamente son puntos de continuidad de F, el lado

izquierdo es

1

2

(F(y) +F(y))

1

2

(F(x) +F(x)).

Demostracion. Para T > 0 sea

I(T) =

1

2

_

T

T

e

itx

e

ity

it

(t) dt

=

1

2

_

T

T

e

itx

e

ity

it

[

_

e

itz

dF(z)] dt

=

1

2

_

T

T

_

e

it(zx)

e

it(zy)

it

dF(z) dt

=

1

2

_

_

T

T

e

it(zx)

e

it(zy)

it

dt dF(z).

www.cienciamatematica.com

w

w

w

.

.

c

o

m

M

a

t

e

m

a

t

i

c

a

1

Cap

tulo 8. Funciones generadoras 331

El cambio en el orden de integracion es permitido pues el integrando es una

funcion continua y acotada en t [T, T] y z R, incluyendo cuando t = 0,

pues puede denirse esta funcion de acuerdo a su comportamiento lmite en

ese punto, es decir,

lm

t0

e

it(zx)

e

it(zy)

it

= y x.

Desarrollando las exponenciales en terminos de senos y cosenos se obtiene

I(T) =

1

2

_

_

T

T

1

it

( cos t(z x) +i sen t(z x)

cos t(z y) i sen t(z y) ) dt dF(z),

en donde para cualquier n umero real a, por ser coseno una funcion par, y

seno una funcion impar,

_

T

T

cos(at)

t

dt = 0,

y

_

T

T

sen(at)

t

dt = 2

_

T

0

sen(at)

t

dt.

Por lo tanto

I(T) =

1

2

_

( 2

_

T

0

sen t(z x)

t

dt 2

_

T

0

sen t(z y)

t

dt ) dF(z).

El siguiente paso consiste en aplicar el teorema de convergencia dominada

cuando T . La integral I(T) es la esperanza de la variable aleatoria

X

T

=

1

2

( 2

_

T

0

sen t(X x)

t

dt 2

_

T

0

sen t(X y)

t

dt ).

Nos interesa encontrar el lmite de esta variable cuando T . Para ello

se hace uso del siguiente resultado no trivial:

lm

T

2

_

T

0

sen at

t

dt = signo(a) =

_

_

_

si a > 0,

si a < 0,

0 si a = 0.

www.cienciamatematica.com

w

w

w

.

.

c

o

m

M

a

t

e

m

a

t

i

c

a

1

332 8.3. Funci

on caracter

stica

Entonces, puntualmente,

lm

T

X

T

=

1

2

( signo(X x) signo(X y) )

=

1

2

1

{x,y}

(X) + 1

(x,y)

(X)

=

_

_

0 si X < x,

1/2 si X = x,

1 si x < X < y,

1/2 si X = y,

0 si X > y.

Ademas, las variables X

T

estan acotadas en valor absoluto por una constante

pues para cualquier n umero real a,

|

_

T

0

sen at

t

dt| sup

T>0

|

_

T

0

sen t

t

dt| < .

Por lo tanto

lm

T

I(T) =

_

[

1

2

1

{x,y}

(z) + 1

(x,y)

(z) ] dF(z)

=

1

2

P(X = x) +

1

2

P(X = y) +P(x < X < y)

= P(x < X y) +

1

2

P(X = x)

1

2

P(X = y)

= F(y) F(x) +

1

2

P(X = x)

1

2

P(X = y)

=

1

2

(F(y) +F(y))

1

2

(F(x) +F(x)).

En particular, si x y y son puntos de continuidad de F, entonces el lmite

de la integral es igual a F(y) F(x).

Como corolario del teorema de inversion demostraremos que la funcion ca-

racterstica determina de manera unica a la distribucion de probabilidad.

www.cienciamatematica.com

w

w

w

.

.

c

o

m

M

a

t

e

m

a

t

i

c

a

1

Cap

tulo 8. Funciones generadoras 333

Teorema de unicidad. Si X y Y son tales que

X

(t) =

Y

(t) para

todo valor real de t, entonces X y Y tienen la misma distribucion.

Demostracion. Sea (t) la funcion caracterstica com un. Sea z cualquier

n umero real, y sean x y y tales que x < z < y. Haciendo x tender a , y

y z, en la formula de inversion de L`evy, se obtiene una unica funcion de

distribucion dada por

F(z) = lm

yz

lm

x

lm

T

1

2

_

T

T

e

itx

e

ity

it

(t) dt.

Cuando la condicion

X

(t) =

Y

(t) solo se cumple en una vecindad del

cero, no es necesariamente cierto que la distribucion de probabilidad queda

completamente especicada. Vease [13] para un ejemplo al respecto.

En el caso absolutamente continuo se tiene la siguiente formula explcita.

Proposici

on (F

ormula de inversi

on en el caso abs. continuo).

Sea X absolutamente continua con funcion de densidad f(x), y funcion

caracterstica (t). Entonces

f(x) =

1

2

_

e

itx

(t) dt.

Demostracion. Sean x < y, dos puntos de continuidad de F. Por el teorema

www.cienciamatematica.com

w

w

w

.

.

c

o

m

M

a

t

e

m

a

t

i

c

a

1

334 8.3. Funci

on caracter

stica

de inversion de L`evy, y por el teorema de Fubini,

F(y) F(x) = lm

T

1

2

_

T

T

e

itx

e

ity

it

(t) dt

=

1

2

_

e

itx

e

ity

it

(t) dt

=

1

2

_

__

y

x

e

itx

dx

_

(t) dt.

=

_

y

x

_

1

2

_

e

itx

(t) dt

_

dx.

Por lo tanto el integrando debe ser la funcion de densidad de X.

Es necesario se nalar que el uso de esta formula requiere conocer de antemano

que la funcion caracterstica proviene de una variable aleatoria absoluta-

mente continua. De aqui surge el problema, que unicamente mencionamos,

de encontrar condiciones sobre (t) que garanticen que la correspondiente

variable aleatoria es absolutamente continua.

Ahora se demuestra un resultado que sera de utilidad en la ultima parte

del curso y que establece que la convergencia en distribuci on es equivalente

a la convergencia puntual de las correspondientes funciones caractersticas.

El resultado es valido como esta enunciado pero solo demostraremos una de

las implicaciones.

Teorema de Continuidad. Sean X, X

1

, X

2

, . . . variables aleatorias.

Entonces X

n

d

X si, y solo si,

X

n

(t)

X

(t).

Demostracion. () Suponga que

X

n

(t)

X

(t). Entonces para dos pun-

tos de continuidad x < y de F

X

, el teorema de inversion de L`evy establece

www.cienciamatematica.com

w

w

w

.

.

c

o

m

M

a

t

e

m

a

t

i

c

a

1

Cap

tulo 8. Funciones generadoras 335

que

F

X

(y) F

X

(x) = lm

T

1

2

_

T

T

e

itx

e

ity

it

(t) dt.

= lm

T

1

2

_

T

T

e

itx

e

ity

it

[ lm

n

X

n

(t) ] dt.

= lm

n

lm

T

1

2

_

T

T

e

itx

e

ity

it

[

X

n

(t) ] dt.

= lm

n

F

X

n

(y) F

X

n

(x).

Haciendo x tender a se obtiene F

X

(y) = lm

n

F

X

n

(y).

En el siguiente captulo usaremos este resultado para demostrar el teorema

central del lmite. Finalmente mencionamos la denicion de funcion carac-

terstica para vectores aleatorios. La f.c. del vector (X, Y ) es la funcion

X,Y

(s, t) = E(e

isX

e

itY

), para valores reales de s y t donde esta esperan-

za sea absolutamente convergente. Nuevamente puede demostrarse que las

variables X y Y son independientes si, y solo si,

X,Y

(s, t) =

X

(s)

Y

(t).

De manera analoga puede denirse la funcion caracterstica para vectores

de dimension mayor.

www.cienciamatematica.com

w

w

w

.

.

c

o

m

M

a

t

e

m

a

t

i

c

a

1

336 8.4. Ejercicios

8.4. Ejercicios

Funcion generadora de probabilidad

537. Sea X con varianza nita y con f.g.p. G(t). Demuestre que

a) E(X) = G

(1).

b) E(X

2

) = G

(1) +G

(1).

c) Var(X) = G

(1) +G

(1) [G

(1)]

2

.

538. Sean X y Y independientes, y sean a y b dos constantes. Demuestre

que

a) P(X = k) = G

(k)

(0)/k! para k = 0, 1, . . .

b) G

aX+b

(t) = t

b

G

X

(t

a

).

c) G

XY

(t) = G

X

(t) G

Y

(1/t).

539. Sean X

1

, . . . , X

n

independientes tales que X

k

tiene f.g.p. G

k

(t), para

k = 1, . . . , n. Demuestre que G

X

1

++X

n

(t) = G

1

(t) G

n

(t).

540. Demuestre o proporcione un contraejemplo: Si G

X+Y

(t) = G

X

(t)

G

Y

(t), para valores de t en alg un intervalo no trivial alrededor del

cero, entonces X y Y son independientes.

541. Sea X

1

, X

2

, . . . una sucesion de v.a.i.i.d. con f.g.p. G

X

(t). Sea N otra

variable aleatoria con valores en N, independiente de la sucesion y con

f.g.p. G

N

(t). Sea S = X

1

+ +X

N

. Demuestre que

a) G

S

(t) = G

N

(G

X

(t)).

b) E(S) = E(N)E(X), usando G

S

(t).

c) Var(S) = E

2

(X) Var(N) +E(N) Var(X), usando G

S

(t).

542. Encuentre la funcion generadora de probabilidad, si existe, de una

variable aleatoria con funcion de densidad

www.cienciamatematica.com

w

w

w

.

.

c

o

m

M

a

t

e

m

a

t

i

c

a

1

Cap

tulo 8. Funciones generadoras 337

a) f(x) =

1

x!(e 1)

, para x = 1, 2, . . .

b) f(x) =

1

x(x + 1)

, para x = 1, 2, . . .

543. Sea X con distribucion Ber(p). Demuestre que

a) G(t) = 1 p +pt.

b) E(X) = p, usando G(t).

c) Var(X) = p(1 p), usando G(t).

d) E(X

n

) = p, usando G(t).

544. Sea X con distribucion bin(n, p). Demuestre que

a) G(t) = (1 p +pt)

n

.

b) E(X) = np, usando G(t).

c) Var(X) = np(1 p), usando G(t).

545. Sean X

1

, . . . , X

n

variables aleatorias independientes, cada una con dis-

tribucion Ber(p). Use la f.g.p. para demostrar que la variable X

1

+ +

X

n

tiene distribucion bin(n, p).

546. Sean X y Y independientes con distribucion bin(n, p) y bin(m, p),

respectivamente. Use la f.g.p. para demostrar que la variable X + Y

tiene distribucion bin(n +m, p).

547. Sea X con distribucion bin(N, p), en donde N es una variable aleatoria

con distribucion bin(n, r). Use la f.g.p. para demostrar que X tiene

distribucion bin(n, rp).

548. Sea X con distribucion geo(p). Demuestre que

a) G(t) = p/[1 t(1 p)].

b) E(X) = (1 p)/p, usando G(t).

c) Var(X) = (1 p)/p

2

, usando G(t).

www.cienciamatematica.com

w

w

w

.

.

c

o

m

M

a

t

e

m

a

t

i

c

a

1

338 8.4. Ejercicios

549. Sea X con distribucion Poisson(). Demuestre que

a) G(t) = e

(1t)

.

b) E(X) = , usando G(t).

c) Var(X) = , usando G(t).

550. Sean X y Y independientes con distribucion Poisson con parametros

1

y

2

respectivamente. Use la f.g.p. para demostrar que la variable

X +Y tiene distribucion Poisson(

1

+

2

).

551. Sea X con distribucion bin neg(r, p). Demuestre que

a) G(t) = [p/(1 t(1 p))]

r

.

b) E(X) = r(1 p)/p, usando G(t).

c) Var(X) = r(1 p)/p

2

, usando G(t).

Funcion generadora de momentos

552. Encuentre la funcion generadora de momentos, si existe, de una va-

riable aleatoria con funcion de densidad

a) f(x) =

1

x!(e 1)

, para x = 1, 2, . . .

b) f(x) = e

|x|

/2, para < x < .

553. Sea X con varianza nita y con f.g.m. M(t). Demuestre que

a) E(X) = M

(0).

b) E(X

2

) = M

(0).

c) Var(X) = M

(0) (M

(0))

2

.

554. Sean X y Y independientes e identicamente distribuidas con f.g.m.

M(t). Demuestre que M

XY

(t) = M(t) M(t).

555. Sea X con f.g.m. M

X

(t), y sean a y b dos constantes. Demuestre que

M

aX+b

(t) = e

tb

M

X

(at).

www.cienciamatematica.com

w

w

w

.

.

c

o

m

M

a

t

e

m

a

t

i

c

a

1

Cap

tulo 8. Funciones generadoras 339

556. Sea X con f.g.m. M

X

(t). Diga falso o verdadero, demuestre en cada

caso.

a) M

X

(t) 0.

b) M

2X

(t) = M

X

(2t).

c) M

X

2(t) = M

X

(tX).

557. Sea X con distribucion Ber(p). Demuestre que

a) M(t) = 1 p +pe

t

.

b) E(X) = p, usando M(t).

c) E(X

n

) = p, usando M(t).

d) Var(X) = p(1 p), usando M(t).

558. Sea X con distribucion bin(n, p). Demuestre que

a) M(t) = (1 p +pe

t

)

n

.

b) E(X) = np, usando M(t).

c) Var(X) = np(1 p), usando M(t).

559. Sean X

1

, . . . , X

n

independientes cada una con distribucion Ber(p). Use

la f.g.m. para demostrar que la variable X

1

+ +X

n

tiene distribucion

bin(n, p).

560. Sean X y Y independientes con distribucion bin(n, p) y bin(m, p) res-

pectivamente. Use la f.g.m. para demostrar que X +Y tiene distribu-

cion bin(n +m, p).

561. Sea X con distribucion geo(p). Demuestre que

a) M(t) = p/[1 (1 p)e

t

].

b) E(X) = (1 p)/p, usando M(t).

c) Var(X) = (1 p)/p

2

, usando M(t).

562. Sea X con distribucion Poisson(). Demuestre que

www.cienciamatematica.com

w

w

w

.

.

c

o

m

M

a

t

e

m

a

t

i

c

a

1

340 8.4. Ejercicios

a) M(t) = exp[(e

t

1)].

b) M

(t) = M

(t) +e

t

M

(t).

c) E(X) = , usando M(t).

d) Var(X) = , usando M(t).

e) E[(X )

3

] = , usando M(t).

563. Sea X con distribucion unif(a, b). Demuestre que

a) M(t) =

e

bt

e

at

(b a)t

.

b) E(X) = (a +b)/2, usando M(t).

c) Var(X) = (b a)

2

/12, usando M(t).

564. Sea X con distribucion exp(). Demuestre que

a) M(t) = /( t), para t < .

b) E(X) = 1/, usando M(t).

c) Var(X) = 1/

2

, usando M(t).

565. Sea X con distribucion N(,

2

). Demuestre que

a) M(t) = exp(t +

2

t

2

/2).

b) E(X) = , usando M(t).

c) Var(X) =

2

, usando M(t).

566. Sean X y Y independientes con distribucion N(

1

,

2

1

) y N(

2

,

2

2

)

respectivamente. Use la f.g.m. para demostrar que X +Y tiene distri-

bucion normal con media

1

+

2

y varianza

2

1

+

2

2

.

567. Sea X con distribucion gama(n, ). Demuestre que

a) M(t) = [/( t)]

n

, para t < .

b) E(X) = n/, usando M(t).

c) Var(X) = n/

2

, usando M(t).

www.cienciamatematica.com

w

w

w

.

.

c

o

m

M

a

t

e

m

a

t

i

c

a

1

Cap

tulo 8. Funciones generadoras 341

568. Sean X y Y independientes ambas con distribucion exp(). Use la

f.g.m. para demostrar que X +Y tiene distribucion gama(2, ).

569. Sean X y Y independientes con distribucion gama(n, ) y gama(m, )

respectivamente. Use la f.g.m. para demostrar que la variable X + Y

tiene distribucion gama(n +m, ).

570. Sea X con distribucion

2

(n). Demuestre que

a) M(t) = [1/(1 2t)]

n/2

, para t < 1/2.

b) E(X) = n, usando M(t).

c) Var(X) = 2n, usando M(t).

571. Use la f.g.m. para demostrar que si X y Y son independientes tales

que X tiene distribucion

2

(n) y X +Y tiene distribucion

2

(m) con

m > n, entonces Y tiene distribucion

2

(mn).

572. Sean X y Y independientes con distribucion

2

(n) y

2

(m) respecti-

vamente. Use la f.g.m. para demostrar que X + Y tiene distribucion

2

(n +m).

573. Sea X con distribucion N(,

2

). Use la f.g.m. para demostrar que

a) X tiene distribucion N(,

2

).

b) aX +b tiene distribucion N(a +b, a

2

2

), con a = 0.

c) (X )

2

/

2

tiene distribucion

2

(1).

574. Sean X

1

, . . . , X

n

independientes tales que X

k

tiene f.g.m. M

k

(t) para

k = 1, . . . , n. Demuestre que M

X

1

++X

n

(t) = M

1

(t) M

n

(t).

575. Sea X con distribucion Cauchy estandar. Demuestre que

M

X

(t) =

_

1 si t = 0,

si t = 0.

576. Sea X con distribucion t(n). Demuestre que

M

X

(t) =

_

1 si t = 0,

si t = 0.

www.cienciamatematica.com

w

w

w

.

.

c

o

m

M

a

t

e

m

a

t

i

c

a

1

342 8.4. Ejercicios

577. Sea n un n umero natural. Demuestre que no existe la f.g.m. de la

siguiente funcion de densidad. Esta distribucion tiene momentos ni-

tos de orden 1, 2, . . . , n 1, pero el n-esimo momento y superiores no

existen.

f(x) =

_

n/x

n+1

si x > 1,

0 otro caso.

Funcion caracterstica

578. Encuentre la funcion caracterstica de una variable aleatoria con fun-

cion de densidad

a) f(x) =

1

x!(e 1)

, para x = 1, 2, . . .

b) f(x) = e

|x|

/2, para < x < .

579. Sea X con funcion caracterstica

X

(t), y sean a y b dos constantes.

Demuestre que

aX+b

(t) = e

itb

X

(at).

580. Demuestre que una funcion de distribucion F(x) es simetrica si, y solo

si, la correspondiente funcion caracterstica (t) es real.

581. Demuestre que la funcion caracterstica es una funcion uniformemente

continua, es decir, para todo > 0 existe > 0 tal que para todo t y

s con |t s| < , se cumple que |(t) (s)| < .

582. Demuestre que la funcion caracterstica satisface la igualdad (t) =

(t), en donde z denota el complejo conjugado de z.

583. Sean

1

(t) y

2

(t) dos funciones caractersticas, y sea [0, 1]. De-

muestre que la combinacion lineal convexa

1

(t) + (1 )

2

(t) es

una funcion caracterstica.

584. Sean X y Y independientes y con identica distribucion. Demuestre

que

XY

(t) = |

X

(t)|

2

, en este caso la funcion caracterstica es una

funcion real por que la variable X Y es simetrica.

www.cienciamatematica.com

w

w

w

.

.

c

o

m

M

a

t

e

m

a

t

i

c

a

1

Cap

tulo 8. Funciones generadoras 343

585. Sea X con distribucion Ber(p). Demuestre que

a) (t) = 1 p +pe

it

.

b) E(X) = p, usando (t).

c) Var(X) = p(1 p), usando (t).

d) E(X

n

) = p, usando (t), con n 1 entero.

586. Sea X con distribucion bin(n, p). Hemos demostrado que la funcion

caracterstica de esta distribucion es (t) = (1 p + pe

it

)

n

. Usando

(t) demuestre ahora que

a) E(X) = np.

b) E(X

2

) = np(1 p +np).

c) Var(X) = np(1 p).

587. Sea X con distribucion Poisson(). Hemos demostrado que la funcion

caracterstica de esta distribucion es (t) = exp[(1 e

it

)]. Usando

(t) compruebe que

a) E(X) = .

b) E(X

2

) = ( + 1).

c) Var(X) = .

588. Sea X con distribucion geo(p). Demuestre que

a) (t) = p/(1 (1 p)e

it

).

b) E(X) = (1 p)/p, usando (t).

c) Var(X) = (1 p)/p

2

, usando (t).

589. Sea X tiene distribucion bin neg(r, p). Demuestre que

a) (t) = [p/(1 (1 p)e

it

)]

r

.

b) E(X) = r(1 p)/p, usando (t).

c) Var(X) = r(1 p)/p

2

, usando (t).

www.cienciamatematica.com

w

w

w

.

.

c

o

m

M

a

t

e

m

a

t

i

c

a

1

344 8.4. Ejercicios

590. Sea X con distribucion unif(a, a). Demuestre que (t) = (sen at)/at.

591. Sea X con distribucion unif(a, b). Demuestre que

a) (t) = [e

ibt

e

iat

]/[it(b a)].

b) E(X) = (a +b)/2, usando (t).

c) Var(X) = (b a)

2

/12, usando (t).

592. Sea X con distribucion N(,

2

). Hemos demostrado que la funcion

caracterstica de esta distribucion es (t) = exp (it

2

t

2

/2). Usando

(t) compruebe que E(X) = y Var(X) =

2

.

593. Sea X con distribucion normal estandar. Use la funcion caracterstica

para demostrar que para n = 0, 1, . . .

E(X

n

) =

_

_

_

n!

2

n/2

(n/2)!

si n es par,

0 si n es impar.

594. Sea X con distribucion exp(). Demuestre que (t) = /( it). Use

(t) para comprobar que E(X) = 1/, y Var(X) = 1/

2

.

595. Sea X con distribucion gama(n, ). Hemos encontrado que la funcion

caracterstica de esta distribucion es (t) = [/(it)]

n

. Usando (t)

compruebe nuevamente que

a) E(X) = n/.

b) E(X

m

) =

(m +n)

m

(n)

, para m = 0, 1, . . .

c) Var(X) = n/

2

.

596. Sean X y Y independientes ambas con distribucion exp(). Use la

funcion caracterstica para demostrar que la variable X + Y tiene

distribucion gama(2, ).

597. Sean X y Y independientes con distribucion gama(n, ) y gama(m, )

respectivamente. Use la funcion caracterstica para demostrar que la

variable X +Y tiene distribucion gama(n +m, ).

www.cienciamatematica.com

w

w

w

.

.

c

o

m

M

a

t

e

m

a

t

i

c

a

1

Cap

tulo 8. Funciones generadoras 345

598. Sea X con funcion de distribucion F(x) = e

x

/(1 +e

x

). Demuestre

que F(x) es efectivamente una funcion de distribucion, y calcule su

funcion caracterstica asociada. Con ayuda de esta ultima encuentre

la esperanza y la varianza de X.

599. Sean X y Y independientes. Demuestre que

XY

(t) =

_

Y

(tx) dF

X

(x) =

_

X

(ty) dF

Y

(y).

600. Mediante el calculo de residuos de la teora de variable compleja puede

demostrarse que la distribucion Cauchy estandar tiene funcion carac-

terstica

(t) =

_

e

itx

1

(1 +x

2

)

dx = e

|t|

.

Suponiendo este resultado, encuentre el error en el siguiente argu-

mento para encontrar la f.g.m. de la distribucion Cauchy: Como

(t) = e

|t|

y M(t) = (it), entonces M(t) = e

|it|

= e

|t|

. El

caso es que no existe la f.g.m. para la distribucion Cauchy.

601. Sean X

1

, . . . , X

n

independientes cada una de ellas con distribucion

Cauchy estandar, es decir, la funcion caracterstica es (t) = e

|t|

.

Use este resultado para demostrar que la v.a. S

n

= (X

1

+ +X

n

)/n

tiene distribucion Cauchy estandar para cualquier valor de n.

www.cienciamatematica.com

S-ar putea să vă placă și

- Funcion Generadora de MomentosDocument17 paginiFuncion Generadora de MomentosGonzo IlhuicatziÎncă nu există evaluări

- Funcion Generadora de MomentosDocument16 paginiFuncion Generadora de MomentosEvelin PinargoteÎncă nu există evaluări

- Matematicas Actuariales 1 Material Ago 28-31Document7 paginiMatematicas Actuariales 1 Material Ago 28-31AleÎncă nu există evaluări

- Integrales Por Sustitución TrigonométricaDocument4 paginiIntegrales Por Sustitución Trigonométricaenrique_n_10Încă nu există evaluări

- PD Introducción A LC Sintaxis y SimbolizaciónDocument38 paginiPD Introducción A LC Sintaxis y SimbolizaciónRoxana DavalosÎncă nu există evaluări

- HuffmanDocument18 paginiHuffmanshabedekam100% (1)

- 1 Controles 2 - Roberto CortezDocument38 pagini1 Controles 2 - Roberto CortezJORGE DURANGOÎncă nu există evaluări

- Estadistica BasicaDocument6 paginiEstadistica BasicaDiana Miriam Escobedo IbarraÎncă nu există evaluări

- PROBABILIDAD (2) ProbabilidadDocument17 paginiPROBABILIDAD (2) ProbabilidadSam Thorbjörn AndersonÎncă nu există evaluări

- EMatemáticas FinitasDocument16 paginiEMatemáticas FinitasEsteban Alonso Guzman FuentesÎncă nu există evaluări

- Notas Inferencia PDFDocument191 paginiNotas Inferencia PDFEduardo PonceÎncă nu există evaluări

- Notas ANum 1Document158 paginiNotas ANum 1cursoparcialÎncă nu există evaluări

- Modelo Lotka - VolterraDocument22 paginiModelo Lotka - VolterraEdson Arturo Quispe SánchezÎncă nu există evaluări

- Semana 5Document49 paginiSemana 5natecita100% (1)

- Combinatoria Examen1 SolucionDocument2 paginiCombinatoria Examen1 SolucionAnonymous iH6noeaX7Încă nu există evaluări

- Ruina Del JugadorDocument20 paginiRuina Del JugadorFreddy Andres NavarreteÎncă nu există evaluări

- Capitulo 5 Distribuciones de Probabilida PDFDocument44 paginiCapitulo 5 Distribuciones de Probabilida PDFDiaz Piedrahita AndresÎncă nu există evaluări

- Edo Con DeriveDocument61 paginiEdo Con DeriveDaniela RomeroÎncă nu există evaluări

- Tarea Procesos EstocasticosDocument2 paginiTarea Procesos EstocasticosPablo Narváez B.Încă nu există evaluări

- Sanchez Angel Solucion Metodo Gauss JordanDocument4 paginiSanchez Angel Solucion Metodo Gauss JordanAngel Sánchez CruzÎncă nu există evaluări

- Hessiano OrladoDocument2 paginiHessiano OrladoAnonymous Tph9x741Încă nu există evaluări

- Excess of LossDocument16 paginiExcess of LossLoco Remember PriestÎncă nu există evaluări

- Práctica 14 Distribuciones Discretas-Parte 2 PDFDocument16 paginiPráctica 14 Distribuciones Discretas-Parte 2 PDFKaren VilcaÎncă nu există evaluări

- Estructuras de Control - CondicionalesDocument21 paginiEstructuras de Control - CondicionalesAlvaro SuarezÎncă nu există evaluări

- 05 em 09 Emaea Unidad1 A1 Linda Lopez.Document2 pagini05 em 09 Emaea Unidad1 A1 Linda Lopez.Arik MatÎncă nu există evaluări

- TALLER #2 Integral Definida e IndefinidaDocument7 paginiTALLER #2 Integral Definida e IndefinidaAndres felipe martinezÎncă nu există evaluări

- Espacios de Probabilidad - Liliana Blanco - Definición y EjemplosDocument9 paginiEspacios de Probabilidad - Liliana Blanco - Definición y Ejemplos............Încă nu există evaluări

- Ecuaciones en DiferenciasDocument12 paginiEcuaciones en DiferenciasJessiel Retis NolbertoÎncă nu există evaluări

- Distribuciones Clase (A, b,0) PDFDocument15 paginiDistribuciones Clase (A, b,0) PDFMario Zarate NÎncă nu există evaluări

- Maco U3 Ea MaooDocument3 paginiMaco U3 Ea MaoomariaÎncă nu există evaluări

- Taller Final Calc Int 2020-2Document2 paginiTaller Final Calc Int 2020-2Liceth Cera100% (1)

- Guia Estimacion PuntualDocument3 paginiGuia Estimacion PuntualSergio AndresÎncă nu există evaluări

- Taller 2 ProbabilidadDocument20 paginiTaller 2 ProbabilidadLore GantisanchÎncă nu există evaluări

- 19 Fase 6 Trabajo ColabDocument19 pagini19 Fase 6 Trabajo ColabHernan PortilloÎncă nu există evaluări

- Capitulo 4Document24 paginiCapitulo 4Arnold Javier Chavez BarahonaÎncă nu există evaluări

- Organización IndustrialDocument85 paginiOrganización Industrialivan hernandez rodriguezÎncă nu există evaluări

- 5 Ejercicios ResueltosDocument9 pagini5 Ejercicios ResueltosDamaris Priscila MamaniÎncă nu există evaluări

- Variables AleatoriasDocument10 paginiVariables AleatoriasJhon JimenezÎncă nu există evaluări

- Variable AleatoriaDocument50 paginiVariable AleatoriaGuido Andres Alvarez100% (1)

- Convexidad de FuncionesDocument14 paginiConvexidad de FuncionesVerónica Pérez RojasÎncă nu există evaluări

- 03 em 06 Emae U3 A10 Linda LopezDocument7 pagini03 em 06 Emae U3 A10 Linda LopezKira Lange RodriguezÎncă nu există evaluări

- Probabilidad y Estadistica UAMDocument31 paginiProbabilidad y Estadistica UAMCarlos Ramses Vergel ZapienÎncă nu există evaluări

- Funcion Generadora de Momentos PDFDocument6 paginiFuncion Generadora de Momentos PDFJhonatan VasconezÎncă nu există evaluări

- KKT PDFDocument32 paginiKKT PDFAlan100% (1)

- Practica 5Document9 paginiPractica 5Said Ivan DominguezÎncă nu există evaluări

- Erazo - Rommel - Tarea 4Document17 paginiErazo - Rommel - Tarea 4raerazo4Încă nu există evaluări

- Método de MellinDocument10 paginiMétodo de MellinPedro Anibal Mendoza LuichoÎncă nu există evaluări

- Manu1 U2 A3 HelbDocument6 paginiManu1 U2 A3 HelbJudith RoldánÎncă nu există evaluări

- Mate 5 1.4.1 Procedimiento para Determinar El Área Bajo La Curva de F (X)Document6 paginiMate 5 1.4.1 Procedimiento para Determinar El Área Bajo La Curva de F (X)Veronika NietoÎncă nu există evaluări

- Semana 3 WaDocument27 paginiSemana 3 WaAlexander Santiago PorrasÎncă nu există evaluări

- Ejercicios V A 1Document3 paginiEjercicios V A 1Andres C.50% (2)

- Tarea 2 PDFDocument4 paginiTarea 2 PDFZarett LopezÎncă nu există evaluări

- Señales AleatoriasDocument46 paginiSeñales AleatoriasEduardo Gauss GaloisÎncă nu există evaluări

- 2.2 Definición de Procesos Aleatorios PDFDocument2 pagini2.2 Definición de Procesos Aleatorios PDFAngel VinajaÎncă nu există evaluări

- Variable AleatoriaDocument7 paginiVariable AleatoriaSistemasUCHÎncă nu există evaluări

- AyPS TP2 2023Document4 paginiAyPS TP2 2023Jaime Pacheco SilvaÎncă nu există evaluări

- Series de Fourier y Transformada de LaplaceDocument26 paginiSeries de Fourier y Transformada de LaplaceTEMOCATIAÎncă nu există evaluări

- Tema 2Document15 paginiTema 2Odis GPÎncă nu există evaluări

- Planos y RectasDocument29 paginiPlanos y RectasAMYNNXXXXÎncă nu există evaluări

- Vectores en El Espacio TridimensionalDocument23 paginiVectores en El Espacio TridimensionalAMYNNXXXX50% (2)

- Funciones Vectoriales y CurvasDocument15 paginiFunciones Vectoriales y CurvasAMYNNXXXXÎncă nu există evaluări

- Ecuaciones Diferenciales de RicattiDocument4 paginiEcuaciones Diferenciales de RicattiAMYNNXXXX100% (3)

- Producto Escalar (Producto Punto)Document26 paginiProducto Escalar (Producto Punto)AMYNNXXXX75% (8)

- Ecuaciones Diferenciales Exactas Con Factor IntegranteDocument17 paginiEcuaciones Diferenciales Exactas Con Factor IntegranteAMYNNXXXX43% (7)

- Ecuaciones Diferenciales de BernoulliDocument7 paginiEcuaciones Diferenciales de BernoulliAMYNNXXXX75% (4)

- Multiplicadores de LagrangeDocument24 paginiMultiplicadores de LagrangeAMYNNXXXX100% (3)

- Ecuaciones Diferenciales HomogeneasDocument16 paginiEcuaciones Diferenciales HomogeneasAMYNNXXXX50% (6)

- Vectores en El PlanoDocument17 paginiVectores en El PlanoAMYNNXXXXÎncă nu există evaluări

- Ecuaciones Diferenciales Con Coeficientes LinealesDocument17 paginiEcuaciones Diferenciales Con Coeficientes LinealesAMYNNXXXX100% (3)

- Ecuaciones Diferenciales ExactasDocument19 paginiEcuaciones Diferenciales ExactasAMYNNXXXX100% (2)

- PROBABILIDADDocument26 paginiPROBABILIDADAMYNNXXXXÎncă nu există evaluări

- Ecuaciones Diferenciales LinealesDocument14 paginiEcuaciones Diferenciales LinealesAMYNNXXXX100% (2)

- Planos Tangentes Rectas Normales A La SuperficieDocument18 paginiPlanos Tangentes Rectas Normales A La SuperficieAMYNNXXXX90% (10)

- Aplicaciones de Máximos y Mínimos de Funciones de Dos VariablesDocument13 paginiAplicaciones de Máximos y Mínimos de Funciones de Dos VariablesAMYNNXXXX100% (8)

- Gradientes y Derivadas DireccionalesDocument20 paginiGradientes y Derivadas DireccionalesAMYNNXXXX86% (7)

- Límites y ContinuidadDocument33 paginiLímites y ContinuidadAMYNNXXXX100% (1)

- Derivación Por Regla de La CadenaDocument26 paginiDerivación Por Regla de La CadenaAMYNNXXXX89% (9)

- Funciones de Varias VariablesDocument17 paginiFunciones de Varias VariablesAMYNNXXXXÎncă nu există evaluări

- Teoremas de Funciones TrascendentalesDocument29 paginiTeoremas de Funciones TrascendentalesAMYNNXXXXÎncă nu există evaluări

- HIPÉRBOLASDocument24 paginiHIPÉRBOLASAMYNNXXXX67% (3)

- La ElipseDocument24 paginiLa ElipseAMYNNXXXXÎncă nu există evaluări

- Identidades TrigonométricasDocument22 paginiIdentidades TrigonométricasAMYNNXXXXÎncă nu există evaluări

- Sistema de Coordenadas Rectangulares o CartesianasDocument29 paginiSistema de Coordenadas Rectangulares o CartesianasAMYNNXXXX0% (1)

- La ElipseDocument16 paginiLa ElipseAMYNNXXXXÎncă nu există evaluări

- HiperbolaDocument12 paginiHiperbolaDaniel SotoÎncă nu există evaluări

- Funciones Trigonométricas InversasDocument7 paginiFunciones Trigonométricas InversasAMYNNXXXXÎncă nu există evaluări

- Ley de Senos y de CosenosDocument19 paginiLey de Senos y de CosenosAMYNNXXXXÎncă nu există evaluări

- Definición de Una RectaDocument15 paginiDefinición de Una RectaAMYNNXXXXÎncă nu există evaluări

- 1.1 Regresion Lineal SimpleDocument9 pagini1.1 Regresion Lineal SimpleNoris GuzmánÎncă nu există evaluări

- Trabajo Practico IV-Estadistica (2015)Document10 paginiTrabajo Practico IV-Estadistica (2015)Vicky AlfieÎncă nu există evaluări

- Apuntes Probabilidad Bloque IIIDocument23 paginiApuntes Probabilidad Bloque IIILiaa Ch33% (3)

- Ejemplos Distribucion Binomial Aplicado A La Ing. QuimicaDocument4 paginiEjemplos Distribucion Binomial Aplicado A La Ing. QuimicaAnabel Hernández0% (1)

- Parcial Estadística y Probabilidad Aplicada - Anderson Gutierrez - Yaison JimenezDocument5 paginiParcial Estadística y Probabilidad Aplicada - Anderson Gutierrez - Yaison JimenezAnderson GUTIERREZ ARIASÎncă nu există evaluări

- Confiabilidad EstructuralDocument127 paginiConfiabilidad EstructuralJoaquin SanchezÎncă nu există evaluări

- Guia Estudio Capitulo RepasoDocument4 paginiGuia Estudio Capitulo RepasoJavier Villegas LilloÎncă nu există evaluări

- Diapositivas Variable AleatoriaDocument32 paginiDiapositivas Variable AleatoriaEcuGroup ConsultoresÎncă nu există evaluări

- Tarea4.2 - PrácticasTema4 - Jose Gutierrez PDFDocument128 paginiTarea4.2 - PrácticasTema4 - Jose Gutierrez PDFJuan AgustínÎncă nu există evaluări

- PUNTOS E Estadística - y - Probabilidad - Semana4 - PDocument5 paginiPUNTOS E Estadística - y - Probabilidad - Semana4 - PVANIAÎncă nu există evaluări

- 06 Presentación DPVA Exponencial 06 Individual-Luis RichardsDocument11 pagini06 Presentación DPVA Exponencial 06 Individual-Luis RichardsLuis Daniel Richards LayaÎncă nu există evaluări

- Variables AleatoriasDocument39 paginiVariables AleatoriasJorgeÎncă nu există evaluări

- Guia 4Document4 paginiGuia 4LuisÎncă nu există evaluări

- Aplicaciones Del Taller III ProbabilidadDocument9 paginiAplicaciones Del Taller III Probabilidadvanegb2014Încă nu există evaluări

- Tarea Modulo 9Document7 paginiTarea Modulo 9Alex GonzalezÎncă nu există evaluări

- Distribución de PoisonDocument5 paginiDistribución de PoisonchichoperuÎncă nu există evaluări

- Guía ExamenDocument47 paginiGuía ExamenAndres David Zuleta GarzonÎncă nu există evaluări

- Estadística I (G. Gamarra A)Document5 paginiEstadística I (G. Gamarra A)Guillermo Gamarra AstuhuamánÎncă nu există evaluări

- Laboratorio 1 Estadística Aplicada I R. Alejandro Cordova 20000138Document9 paginiLaboratorio 1 Estadística Aplicada I R. Alejandro Cordova 20000138Alejandro CordovaÎncă nu există evaluări

- Parte I1Document3 paginiParte I1Pedro MacuarismaÎncă nu există evaluări

- Ruy Alberto Lopez RiosDocument87 paginiRuy Alberto Lopez RiosMedina PabloÎncă nu există evaluări

- Practica6 - Variable - Aleatoria - Discreta-1 - Aleyda LastreDocument19 paginiPractica6 - Variable - Aleatoria - Discreta-1 - Aleyda LastreJamileth LastreÎncă nu există evaluări

- SESION 2. Distribución Normal PFADocument30 paginiSESION 2. Distribución Normal PFAKarmencita GarayÎncă nu există evaluări

- Taller 2Document3 paginiTaller 2Jesus Villarraga PalominoÎncă nu există evaluări

- Procesos 2012Document328 paginiProcesos 2012Luis CabCoÎncă nu există evaluări

- Ejercicios Sobre Variable Aleatoria PDFDocument2 paginiEjercicios Sobre Variable Aleatoria PDFRichard Dario Hernandez100% (1)

- Lineas de Espera - 1Document23 paginiLineas de Espera - 1Raul HernandezÎncă nu există evaluări

- Distribucion Binomial NegativaDocument13 paginiDistribucion Binomial NegativaHugo Martinez0% (1)

- Muestreo e Intervalos de ConfianzaDocument64 paginiMuestreo e Intervalos de ConfianzaRoberto JulcaÎncă nu există evaluări

- Distribución de ProbabilidadesDocument39 paginiDistribución de Probabilidadesgerardoarmijo96% (47)