Documente Academic

Documente Profesional

Documente Cultură

Mate Ejercicios 3 v2005

Încărcat de

Jessica RamirezTitlu original

Drepturi de autor

Formate disponibile

Partajați acest document

Partajați sau inserați document

Vi se pare util acest document?

Este necorespunzător acest conținut?

Raportați acest documentDrepturi de autor:

Formate disponibile

Mate Ejercicios 3 v2005

Încărcat de

Jessica RamirezDrepturi de autor:

Formate disponibile

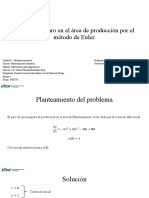

Matemticas para Economistas

Ejercicios resueltos Primer borrador

Captulo 3

Elementos de lgebra Lineal

3.1 Valores y vectores propios

3.1.1

Demostraciones

Comente o demuestre segn sea el caso:

a. [PD3 2003 I] Los valores propios de la matriz A son iguales a los

valores propios de su transpuesta.

S

OLUCIN

Partimos de que la afirmacin es verdadera, por lo tanto: A I = 0 si y

solo si A ' I = 0 ; es decir que el polinomio caracterstico es el mismo

para A y A ' , con los mismos valores propios.

A I = A ' I = 0

Finalmente, podemos verificar que:

( A I ) ' = A I , dado que B = B '

matriz B.

b. [PD3 2003 I] Los valores propios de la inversa de la matriz A son las

inversas de los valores propios de A.

S

OLUCIN

Partimos de la ecuacin fundamental para relacionar vectores propios con

valores propios:

Av = v

Matemticas para Economistas

Ejercicios resueltos Primer borrador

Premultiplicamos ambos lados de la ecuacin por la inversa de A:

A1Av = A1 v v = A1 v

Con lo que finalmente llegamos a la siguiente expresin.

1

A 1v = v

Como son los valores propios de A; dada la ecuacin a la que llegamos,

se demuestra que 1 son los valores propios de A1 . Por lo tanto, la

afirmacin es verdadera.

c. [PD3 2003 I] Los valores propios de una matriz ortogonal slo pueden

tomar los valores de 1 -1.

S

OLUCIN

Si A es una matriz ortogonal, entonces se cumple que: A ' = A1 .

Entonces, debemos utilizar esta propiedad para deducir los valores

propios de A. As, por definicin de valores y vectores propios, tenemos

que:

Av = v

Premultiplicamos ambos lados de la ecuacin por A1 , y obtenemos:

A1Av = A1 v

v = A1 v

v = A ' v

(1)

Sabemos que los valores propios de A son los valores propios de su

transpuesta, tal como se demostr en (a).

(2)

A ' v = v

Reemplazando (2) en (1):

v = v

(1 ) v =

2

Como por definicin, v , entonces necesariamente 1 2 = 0 , de

donde se obtiene que: 1 = 1 y que 2 = 1 . Por lo tanto, se demuestra

que la afirmacin es verdadera.

d. [PD3 2003 I] La suma de los valores propios asociados a la matriz A es

igual a la traza de dicha matriz.

S

OLUCIN

Sea A una matriz que se puede diagonalizar mediante la matriz P, de tal

manera que se obtiene la matriz: D = P 1AP , que contiene a los valores

propios en la diagonal. Lo que queremos demostrar es:

Traza ( D ) =

, donde

i

i son los valores propios de A.

Utilizando la propiedad de que Traza(AB ) = Traza(BA) , tenemos que:

Matemticas para Economistas

Ejercicios resueltos Primer borrador

Traza ( D ) = Traza ( P 1AP ) = Traza ( APP 1 ) = Traza ( A ) ,

Traza ( A) = Traza ( D ) = i

Se demuestra que la afirmacin es verdadera.

e. [PD3 2003 I] El producto de los valores propios asociados a la matriz

A, es igual al determinante de dicha matriz.

S

OLUCIN

Nuevamente, partimos de la matriz D = P 1AP

1

D = P 1AP = P 1 A P =

A P = A

P

Propiedad: AB = A B

Como la matriz D contiene a los valores propios de A y el determinante

de una matriz diagonal es el producto de los elementos de la diagonal

principal:

Se demuestra que la afirmacin es verdadera.

i = A

f. [PD3 2003 I] Si A es una matriz definida como el producto de una

matriz ortogonal y una matriz involutiva, entonces tiene valores propios

iguales a 1 -1.

S

OLUCIN

Si los valores propios de A son 1 1, esta descripcin corresponde a una

matriz ortogonal. A = BC

B es ortogonal: B ' = B 1

C es involutiva: C 2 = I CC = I C = C 1

Si A es ortogonal, entonces AA ' = BCC ' B ' = I . Para que esto ocurra,

CC ' = I . Esto ocurrir nicamente si C es simtrica, condicin que no se

establece en el problema. Por lo tanto la afirmacin es incierta.

g. [PD3 2003 I] Si la matriz A de orden n x n tiene valores propios

iguales a , entonces se cumple:

n

m

1

TRAZA ( A1 ) = m

i =1

OLUCIN

Aqu se conjugan 3 propiedades:

(i) Valores propios de A1 son iguales a la inversa de los valores propios

de A.

(ii) Traza de A es la suma de sus valores propios.

Matemticas para Economistas

Ejercicios resueltos Primer borrador

(iii) Valores propios de Am son los valores propios de A elevados a la m.

Av = v

AAv = Av

AAv = Av

AA2 v = A2 v

An v = n v

l.q.q.d

A2 v = 2 v

A2 v = 2 v

A3 v = 3 v

h. (PC2 2002-II) Los vectores propios de la matriz diagonalizable Anxn,

podran generar al espacio Rn.

S

OLUCIN

Verdadero, puesto que al ser A una matriz diagonalizable, P 1 existe, lo

cual implica que el determinante de P es distinto de cero y que los

vectores propios (n columnas de la matriz P) son linealmente

independientes. Por propiedad, stos sern base de Rn .

i. (PC2 2002-II) Los valores propios de una matriz no simtrica son

siempre ortonormales.

S

OLUCIN

Falso. Debemos recodar que, de la relacin [A I ] v = de donde se

obtiene los vectores propios de la matriz A, la matriz [A I ] es singular

por lo que se forma un sistema de ecuaciones para los elementos del

vector v que est sobre-identificado. De este modo, es necesario imponer

una parmetro o algn tipo de condicin (tal como la de hacer que los

vectores tengan mdulo igual a 1). As, para que los vectores propios de

una matriz simtrica sean ortonormales deben ser ortogonales (por

definicin, lo son), pero tambin deben tener mdulo igual a la unidad,

algo que no se cumple en la generalidad de los casos sino que depende de

cmo stos hayan sido normalizados.

j. (PC2 2002-II) Si v 1 , v 2 y v 3 son vectores propios de una matriz A

asociados con un mismo valor propio, luego el vector av 1 + bv 2 + cv 3 (a, b,

c R) es tambin un vector propio de A asociado con el mismo valor

propio.

S

OLUCIN

Tenemos:

Av 1 = v 1

Av 2 = v 2

Av 3 = v 3

Supongo:

Matemticas para Economistas

Ejercicios resueltos Primer borrador

av 1 + bv 2 + cv 3 = vector propio asociado a

A [av 1 + bv 2 + cv 3 ] = [av 1 + bv 2 + cv 3 ]

aAv 1 + bAv 2 + cAv 3 = a v 1 + b v 2 + c v 3

No existe contradiccin, por lo tanto la afirmacin es verdadera.

k. (PC2 2002-II) Si una matriz mgica1 M de orden q se multiplica por

un escalar b, entonces sus valores propios ya no tendrn porqu sumar

cero.

S

OLUCIN

Una matriz mgica es aquella matriz de orden n ( n 3 ), formada por

nmeros del 0 al n2, que tiene la particularidad de que uno de sus valores

propios, la suma de los elementos de cada una de sus filas, de cada una de

sus columnas y de su diagonal principal es el mismo valor.

Si sabemos que la traza de M es la suma de sus valores propios y que uno

de sus valores propios es igual a la suma de los elementos de la diagonal

principal, entonces la suma de los valores propios restantes debe ser cero,

por lo que la afirmacin es falsa. Solamente los n-1 valores propios

restantes suman cero.

l. [PC2 2003 I/ PC2 2001 II] M es una matriz cuadrada y se conoce un

vector no nulo Z, tal que MZ = , entonces:

(i) Las filas de M son L.I.

S

OLUCIN

Recordemos que una matriz es invertible cuando sus filas y/o columnas

son L.I, es decir, cuando su determinante es distinto de cero. En este caso,

si asumimos que sus filas son L.I y que sus columnas tambin lo son,

entonces M ser invertible y se verificar que:

M 1MZ =

Z =

lo cual es una contradiccin pues Z es un vector distinto del nulo. Por lo

tanto, las filas de M podrn ser L.I nicamente cuando sus columnas sean

L.D, de modo que M sea no invertible.

(ii) Se puede afirmar que Z es un vector propio de la matriz M.

S

OLUCIN

Ver si se ha definido previamente una matriz o cubo mgico.

Matemticas para Economistas

Ejercicios resueltos Primer borrador

Por definicin de valores y vectores propios (la relacin fundamental),

tendramos que:

MZ = Z

( M I ) Z =

Sin embargo, como tenemos la premisa MZ = , y que Z es un vector no

nulo, entonces si podramos afirmar que Z puede ser un vector nulo de la

matriz M, siempre y cuando est asociado a un valor propio igual a cero.

m. [PC2 2002 I] Demostrar que si D es la matriz que resulta de

diagonalizar A, es decir si: D = P 1AP , entonces para todo n > 0 se

cumple An = PD n P 1

S

OLUCIN

Partimos de que A = PDP 1 , y procedemos a obtener las potencias de la

matriz A:

AA = A2 = ( PDP 1 )( PDP 1 ) = PDDP 1 = PD 2P 1

A2A = A3 = ( PD 2P 1 )( PDP 1 ) = PD 2DP 1 = PD 3P 1

as sucesivamente se verifica que An = PD n P 1

n. [PC2 2002 I] Si A y B son 2 matrices simtricas de orden n y AB=BA,

entonces los vectores caractersticos que diagonalizan la matriz A son los

mismos que los vectores caractersticos que diagonalizan a la matriz B.

S

OLUCIN

Procedemos a la diagonalizacin de ambas matrices:

AB = BA

La relacin que determina los valores y vectores propios de la matriz A es:

Av = v

Si premultiplicamos por la matriz B en ambos lados de la igualdad,

obtenemos la siguiente relacin.

BAv = Bv

Asumiendo que efectivamente el enunciado es vlido, entonces la relacin

anloga a (1) para el caso de la matriz B sera:

Bv = v

Premultiplicamos por la matriz A:

ABv = Av

Usando la condicin de que AB=BA:

BAv = Av

Por lo tanto, sobre la base de (1)

Bv = Av = v

Por lo tanto, la afirmacin es verdadera.

q. [PC2 2003 I] Los valores propios de la matriz B = A1 / 2 tal que

BB = A1/ 2A1/ 2 = A ) son iguales a la raz cuadrada de los valores propios

de la matriz A.

Matemticas para Economistas

Ejercicios resueltos Primer borrador

OLUCIN

Sea B = A1 / 2 . Entonces podramos demostrar la falsedad del enunciado

dos formas distintas.

1era forma

Usemos la relacin fundamental para valores y vectores propios de la

matriz B.

BvB = B vB

Por propiedad

B 2vB = B BvB

AvB = B B vB

2

AvB = B vB

Por lo tanto

Entonces de aqu se podra afirmar que los valores propios de A sern

iguales a los cuadrados de los valores propios de B. Sin embargo, la

proposicin inversa, es decir que B tiene como valores propios a la raiz

cuadrada de los valores propios de A se cumplir de manera estricta

nicamente cuando A tenga valores propios positivos.

2da forma

La diagonalizacin de B se lleva a cabo como: DB = PB1BPB de modo que

B = PB DPB1 . Entonces :

A= BB = ( PB DB PB1 )( PB DB PB1 ) = PB DB DB PB1 = PB DB2 PB1

donde la matriz DB2 es diagonal y tiene como elementos a los cuadrados

de los valores propios de B. Se puede deducir rpidamente que esto ser

cierto nicamente cuando la matriz A tenga valores propios positivos.

Por ejemplo, los valores propios de la matriz

1 5

M=

3 6

son iguales a 1M = 1.1098 y 2M = 8.1098 . Ahora los valores propios de

la matriz N = M 2 sern 1N = 1.2316 2N = 65.7684 , y como sabemos:

1N = 1.1098 y 1N = 8.1098 . De esta manera, no se puede saber a

ciencia cierta cul ser el signo que corresponda efectivamente a los

valores propios de M.

r. Los valores propios de la matriz A + kI

propios de la matriz A sumados en k.

son iguales a los valores

SOLUCIN

Partimos de la obtecin de valores y vectores propios para la matriz A. Es

decir:

Av = v

Si sumamos a ambos lados de la ecuacin el trmino kvI, entonces

podemos determinar que los valores propios de la matriz (A+kvI) son

iguales a los valores propios de A (es decir, ) sumados por k.

Matemticas para Economistas

Ejercicios resueltos Primer borrador

Av + kvI = v + kvI

( A + kI ) v = ( + k ) v

. [PC 2004 I] Sea A una matriz de orden n, y sea DA la matriz que

resulta de diagonalizar A. Entonces, el polinomio caracterstico de A es

idntico al polinomio caracterstico de DA .

S

OLUCIN

El polinomio caracterstico de una matriz cuadrada cualquiera, es la

expresin de donde provienen los valores propios de dicha matriz. As, si

consideramos la matriz B, su polinomio caracterstico se obtiene de:

P (B ) = B B I = 0 , donde B es la interrogando o variable a ser

determinada. De esta manera, la proposicin que debemos verificar

implica la siguiente igualdad: A I n = DA I n . Podemos hacer uso

de la expresin de DA en funcin de la matriz A, o viceversa. Por

ejemplo, si consideramos DA = P 1AP , tendremos que:

DA I n = ( P 1AP ) I n = P 1AP P 1P

Pre y post multiplicando P y P 1 obtenemos que

P 1AP P 1P = P 1 ( A I ) P

Por propiedades de determinantes, llegamos a que:

P 1 ( A I n ) P = P 1 A I n P = A I n

A I n = DA I n

3.1.2

La descomposicin de Cholesky

[PC2 2002 II]

Una matriz G simtrica, diagonalizable y de valores propios no negativos,

puede ser descompuesta como G = CC ' donde C es una matriz no singular

denominada raz cuadrada de G (esto es la descomposicin de Cholesky, de la

matriz G).

a. Halle C en funcin de las matrices relevantes en la diagonalizacin de G.

S

OLUCIN

G simtrica cumple con la descomposicin cannica; es decir:

DG = P 'GP

1

Donde P ' = P , debido a que se trata de una matriz simtrica. Por lo tanto:

G = PDG P '

G = CC ' = P ( DG1 / 2DG1 / 2 ) P '

Donde D

es una matriz diagonal cuyos elementos son las races cuadradas

de los valores propios de G.

1/2

G

Matemticas para Economistas

Ejercicios resueltos Primer borrador

G = CC ' = ( PDG1 / 2 )( PDG1 / 2 )

C = PDG1 / 2

b. Aplicando el resultado de a), realice la descomposicin de Cholesky de la

matriz A si se sabe que :

1

A=

2

OLUCIN

Hallamos los valores y vectores propios para construir P y D.

1

= (1 )( 3 ) 2 = 0

De aqu, el polinomio caracterstico de esta matriz es:

2 4 + 1 = 0

Finalmente, los valores propios son:

1 = 0.2679 y 2 = 3.7321

Para 1 = 0.2679 :

1

0.7321 2 v11 0

= v1 = t 2

2 2.7321 v12 0

2.7321

Normalizamos el vector propio de manera que sea ortonormal (por ser matriz

simtrica):

1

0.888

2

1

2

=1

norm

t 1

t

=

v

=

1.268

2.7321

0.4597

2.7321

Hago lo mismo con 2 = 3.7321 y obtengo:

0.4597

v norm

=

2

0.888

Procedemos con la Descomposicin:

0.888 0.4597 0.2679

C = PDG1 / 2 =

0.4597 0.888

0

3.7321

Matemticas para Economistas

Ejercicios resueltos Primer borrador

3.1.3

Descomposicin triangular

[PC2 2001 II]

Toda matriz A puede ser descompuesta como el producto de dos matrices LU

(es decir A = L por U), donde U es triangular superior (upper); y L es una

matriz triangular inferior (lower), cuya diagonal (diagonal de L) tiene todos

sus elementos iguales a uno (descomposicin LU a la Crout).

Dado el siguiente sistema de ecuaciones lineales:

8x + y + 6z = 28

3x + 5y + 7z = 34

4x + 9y + 2z = 28

a. Llevar a cabo la descomposicin LU (A = LU) a la Crout de la matriz de

coeficientes del sistema.

S

OLUCIN

Tenemos:

8 1 6 1

0 0 U 11 U 12

3 5 7 = L21 1 0 . 0 U 22

4 9 2 L31 L32 1 0

0

U 11

U 12

= U 11L21 U 12 L21 + U 22

U 11L31 U 12 L31 + U 22 L32

U 13

U 23

U 33

U 13 L21 + U 23

U 13 L31 + U 23 L32 + U 33

U 13

Obtenemos los valores de los elementos que puedne ser identificados

directamente:

U 11 = 8 , U 12 = 1 , U 13 = 6

Finalmente, con estos valores, obtenemos los elementos restanes:

L21 = 3 8 , U 22 = 37 8 , U 23 = 38 8 , L31 = 1 2 , L32 = 68 37 , y U 33 = 360 37

Con ello, las matrices L y U son:

1

0

0

L = 3 8

1

0

1 2 68 37 1

1

6

U = 0 37 8

38 8

0

0

360 37

b. Verificar que es posible expresar la matriz resultante del proceso de

eliminacin Gaussiano (para resolver sistemas lineales) en funcin a L.

S

OLUCIN

Antes, notemos que la primera fila de U es la misma que la matriz original.

Irrelevante

10

Matemticas para Economistas

Ejercicios resueltos Primer borrador

8 1 6 28

3 5 7 34

4 9 2 28

F2 3/8F1

F3 1/2F1

8

1

6

0 37 / 8 19/ 4

1

0 17 / 2

Fila Pivot

F3 (17/2)(8/37)F2

1

6

0 37 / 8

19/ 4

0

360/ 37

0

La ltima matriz es la que resulta del proceso de eliminacin de Gauss.

A = LU

donde U es la matriz que resulta del Proceso de eliminacin de Gauss.

U = F (L) = L1A .

c. Mostrar que la multiplicidad algebraica de los valores propios de L es igual

a su traza.

S

OLUCIN

La matriz L que obtuvimos es triangular inferior. Este tipo de matrices

(triangulares) tienen la propiedad de que su determinante es el producto de los

elementos de su diagonal principal. As:

1

0

0

L = 3 / 8

1

0

1/2 68 / 37 1

L =1

Si multiplicidad algebraica es , nmero de veces que se repiten los valores

propios, entonces:

= Traza(L) = 3

Si: L = 1 , = Traza (L) = 3 , valores propios repetidos, diagonal igual a 1; no

es difcil suponer que todos los valores propios son iguales a 1. Evidentemente,

se pueden hallar los valores propios de la forma convencional y obtener:

1 = 2 = 3 = 1 .

d. Si A1 = MN , hallar M y N en funcin de L y de U.

S

OLUCIN

Debemos obtener una forma para la matriz inversa de A, tal que:

A1 = MN

Utilizando la descompocin que acabamos de realizar, podemos determinar a

la matriz inversa de A en funcin d elas inversas de las matrices L y U. As:

11

Matemticas para Economistas

Ejercicios resueltos Primer borrador

A = LU A1 = U 1L 1

Finalmente:

M = U 1 N = L1 .

3.1.4

La matriz de Hadamard

[PC2 2003 I]

Se dice que una matriz simtrica H de orden n es una matriz de Hadamard si

sus elementos son iguales a 1 1 de manera que HH = HH = nIn donde In

es una matriz identidad de orden n. Por ejemplo, se puede comprobar que

1 1

1 1

1 1 1 1

1 1 1 1

1 1 1 1

1 1 1 1

1 1 1 1

1 1 1 1

1 1 1 1

1 1 1 1

son matrices de Hadamard de orden 2, 4 y 4 respectivamente2. Con esta

informacin, determine los valores propios de una matriz Hadamard de orden

n.

S

OLUCIN

Partimos de la relacin fundamental de valores y vectores propios para la

matriz H. Es decir, en genera si v es un vector propio de H asociado al valor

propio , entonces:

Hv = v

[H I ] v =

Si pre-multiplicamos por H para utilizar las propiedades de la matriz de

Hadamard llegaremos a que:

H ' [H I ] v =

[H ' H H ' ] v =

[nI H '] v =

nv ( H ' v ) =

Por propiedades de valores y vectores propios, los valores propios de la

traspuesta de una matriz son iguales a los valores propios de la matriz

original. Entonces se cumple que H ' v = v y la expresin (*) se puede

rescribir como:

nv ( v ) =

(n ) v =

2

dado que por definicin v , entonces

(n ) = 0

2

1 = n

y 2 = + n

Estos ejemplos no son relevantes para la resolucin de este problema.

12

Matemticas para Economistas

Ejercicios resueltos Primer borrador

3.1.5

Una diagonalizacin trigonomtrica

[PC2 2003 I]

Considera una matriz A, simtrica, y su respectiva matriz3 P.

0.5b

cos ( ) sen ( )

a

P =

A=

0.5b

c

sen ( ) cos ( )

Como es usual, en su forma ms general, su diagonalizacin se lleva a cabo

con la expresin D = P 1AP

Ayuda: funciones trigonomtricas del ngulo doble.

sen ( 2A ) = 2sen ( A ) cos ( A )

cos ( 2A ) = cos2 ( A ) sen 2 ( A )

a. Sustenta por qu P tendra nicamente valores propios 1 o 1.

S

OLUCIN

Primero que nada debemos notar que al ser A simtrica, es posible trabajar

con su descomposicin cannica. Ahora, es sencillo verificar que P cumple con

ser ortogonal puesto que P ' = P 1 .

cos ( ) +sen ( )

P' =

sen ( ) cos ( )

Para hallar la inversa utilizamos el artificio para matrices de 2 x 2 que dice

que debemos multiplicar la inversa del determinante de la matriz por una

matriz que tiene como elementos de la diagonal principal, los mismo que los de

la matriz original pero cambiados de lugar, y como elementos de la diagonal

secundaria a los mismos elementos de la matriz original, pero con el signo

cambiado. Es decir:

1 cos ( ) +sen ( )

=

det ( P ) sen ( ) cos ( )

donde al ser se comprueba la

igualdad P ' = P 1 , puesto que por

propiedades geomtricas conocidas se

sabe que

1

=1

det ( P ) ==

2

( cos ( ) + sen 2 ( ) )

Ahora, dado que P es ortogonal, por propiedad nicamente podr tener

valores propios iguales a 1 y 1.

b. Lleva a cabo la diagonalizacin de A y verifica que4:

1

b

= arctan

2

a c

3

4

Esta matriz se llama matriz de rotacin.

Esto es nicamente: si y = arctan(x), entonces x = tan(y). Es decir, se debe tratar de formar la tan(2).

13

Matemticas para Economistas

Ejercicios resueltos Primer borrador

OLUCIN

Ahora, realizamos la descomposicin

cos ( ) sen ( )

DA = P ' AP =

sen ( ) cos ( )

0.5b cos ( ) sen ( )

a

0.5b

c sen ( ) cos ( )

De este modo, la matriz DA tomar la siguiente forma:

DA11 DA12

DA =

DA21 DA22

donde:

DA11 = a cos2 ( ) + bsen ( ) cos ( ) + csen 2 ( )

b

DA12 = cos2 ( ) sen 2 ( ) + (c a ) sen ( ) cos ( )

2

b

DA21 = cos2 ( ) sen 2 ( ) + (c a ) sen ( ) cos ( )

2

DA22 = asen 2 ( ) + bsen ( ) cos ( ) + c cos2 ( )

Esto es, la matriz DA ser diagonal siempre que los trminos de la diagonal

secundaria sean iguales a cero:

b

cos2 ( ) sen 2 ( ) + (c a ) sen ( ) cos ( ) = 0

2

Utilizamos las formulas que nos dieron y obtenemos:

b

1

cos ( 2 ) + (c a ) sen ( 2 ) = 0

2

2

para que esto se cumpla:

1

[b cos ( 2 ) + (c a ) sen ( 2 )] = 0

2

b cos ( 2 ) = (a c ) sen ( 2 )

Por lo tanto:

sen ( 2 )

b

tan ( 2 ) =

=

cos ( 2 ) a c

1

b

= arctan

2

a c

b

2 = arctan

a c

c. Sustenta cada una de estas expresiones, sea verdadera o falsa (ojo: no

siempre es necesario realizar operaciones):

(i) Cuando b = 0 , realizar esta descomposicin, bajo esta forma funcional de

P, carece de sentido.

S

OLUCIN

En efecto, si b = 0 , entonces la matriz A queda como:

14

Matemticas para Economistas

Ejercicios resueltos Primer borrador

a 0

A=

0 c

De esta manera, se observa que la matriz A sigue siendo simtrica, pero ahora

es diagonal, por lo que no es necesario diagonalizarla, dado que los elementos

de su diagonal principal son sus valores propios.

(ii) Cuando b = 0 y a = c , entonces la multiplicidad algebraica de A es igual

a su rango.

S

OLUCIN

En este caso la matriz A queda como:

a 0

A=

0 a

por lo que los valores propios de A son repetidos e iguales a c. Por ello, su

multiplicidad algebraica es igual a 2, que es el rango de A, puesto que es

invertible.

3.1.6

Matrices especiales

[PC2 2003 II]

Una matriz unitaria es aquella cuyos elementos son (todos) iguales a 1. As,

las matrices

1 1

1 1

1 1 1

1 1 1

1 1 1

1

1

1 1 1

1 1 1

1 1 1

1 1 1

son unitarias de orden 2, 3 y 4, respectivamente.

a. Halla los valores propios de una matriz unitaria de orden n. Para ello se

recomienda calcular los valores propios de una matriz unitaria de orden 2,

luego de orden 3 y as sucesivamente hasta que encuentres un patrn claro en

el comportamiento de los valores propios.

S

OLUCIN

(i) Caso de una matriz de 2x2

El polinomio caracterstico de esa matriz, se obtiene a partir de:

1

1

2

det

= (1 ) 1 = 0

1

1

De aqu, los valores propios de la matriz sern:

[(1 ) 1] [(1 ) + 1] = 0

15

1 = 0

2 = 2

Matemticas para Economistas

Ejercicios resueltos Primer borrador

(ii) Caso de una matriz de 3x3

En este caso, el polinomio caracterstico involucra la obtencin del

determinante de una matriz de orden 3.

1

1

1

det 1

1

1

1

1

1

Aplicando la regla de Cramer, obtenemos el polinomio caracterstico:

1

= (1 ) + 1 + 1 (1 ) (1 ) (1 ) = 0

3

Resolviendo esta expresin:

(1 3 + 3

3 ) + 2 3 (1 ) = 0

1 3 + 3 2 3 + 2 3 + 3 = 0

3 2 3 = 2 ( 3 ) = 0

Llegamos a que:

1 = 0

2 = 0

3 = 3

Con esta informacin, ya es sensato generalizar los resultados: los valores

propios de una matriz unitaria de orden n son: 1 = 2 = = n 1 = 0 y

n = n . Sin embargo veamos el caso de matrices de orden 4:

(iii) Caso de una matriz de 4x4

Como es lgico, debemos obtener el determinante de una matriz de orden 4.

Procedemos con el mtodo de los cofactores:

1

1

1

1

1

1

1

1

det

1

1

1

1

1

1

1

1

Fila referencial

Cofactores (para cada elemento de la fila referencial):

1

1

1

1 = 1

1

1

1

1

1

1

1

1

1

2 = 1 1

1

1

1

16

Matemticas para Economistas

Ejercicios resueltos Primer borrador

1 1

1

3 = 1

1

1

1

1

1

1 1

1

1

1

4 = 1

1

1

1

Dado que no hay filas con ceros, tomamos la primera fila como referencial y

aplicamos el mtodo de los cofactores (notemos que para el caso de esta

matriz, sea cual se la fila, el cofactor ser el mismo):

1+1

1+ 2

1+ 3

det ( ) = (1 ) ( 1) det [ 1 ] + (1) ( 1) det [ 2 ] + (1) ( 1) det [ 3 ] +

+ ( 1 ) ( 1 )

1+ 4

det [ 4 ]

del resultado anterior se conoce que: det [ 1 ] = 2 ( 3 ) = 0

Factorizamos:

det ( 2 ) = (1 ) + 1 + 1 (1 ) 1 (1 )

2

= 1 2 + 2 + 2 1 2 + 2

= 2

det ( 3 ) = (1 ) + 1 + (1 ) 1 1 (1 )

= 3 2 2 1 + 2 2

= 2

det ( 4 ) = 1 + 1 + (1 ) 1 (1 ) (1 )

2

= 2 + 1 2 + 2 1 1 + 1 +

= 2

det (

= (1 ) 2 ( 3 ) + ( 1) 2 + ( 2 ) + ( 1) 2

= ( 2 3 ) ( 3 ) 3 2 = 3 2 3 3 3 + 4 3 2

= 4 4 3 = 3 ( 4 ) = 0

de aqu que los valores propios de una matriz unitaria de orden 4, sern:

1 = 0

2 = 0

3 = 0

4 = 4

b. Una matriz de Pier de orden n es definida como aIn + Un donde a es un

nmero real y Un es una matriz unitaria de orden n. Con la ayuda de los

resultados obtenidos en a), calcula los valores propios de una matriz de Pier

de orden n.

S

OLUCIN

1era alternativa

17

Matemticas para Economistas

Ejercicios resueltos Primer borrador

La matriz de Pier tendr la siguiente forma:

1

1 + a

1+a

1

1

aI n + U n = 1

1

1

1

1

1

1

1

1+a

1 + a

As, para obtener sus valores propios se debe resolver:

1

(1 + a )

1

(1 + a )

1

1

det (aI n + U n ) I = det

1

1

1

1

1

1

(1 + a )

(1 + a )

1

De lo visto en (a) esta expresin podra interpretarse como la expresin

necesaria para obtener los valores propios de una matriz unitaria, donde

= a

n = n . De aqu se deduce que:

As: 1 = 2 = = n 1 = 0 y

y

1 = 2 = = n 1 = a

n = a + n

2da alternativa

Otra forma ms eficiente de resolver este problema es con la propiedad de que

los valores propios de la matriz A + kI son iguales a los valores propios de la

matriz A sumados en k.

Es decir:

Av = v

Av + kvI = v + kvI

con lo cual se llega al mismo resultado.

2.1

( A + kI ) v = ( + k ) v

Diagonalizacin (4 puntos)

[PC2 2004 I]

(a) Se dice que dos matrices A y B, de orden n, son simultneamente

diagonalizables, si es que son diagonalizadas por la misma matriz M.

Demuestre que AB=BA y que iAB = iA iB (el valor propio i-simo de AB es

igual al producto del valor propio i-simo de A, por el valor propio i-simo de

B).

Solucin:

18

Matemticas para Economistas

Ejercicios resueltos Primer borrador

Descomponemos las matrices A y B en funcin de sus matrices diagonalizadas:

A = MDA M 1

Entonces:

B = MDB M 1

AB = ( MDA M 1 ) ( MDB M 1 ) = M {DA DB } M 1

(*)

De manera similar:

BA = ( MDB M 1 ) ( MDA M 1 ) = M {DB DA } M 1

(**)

Dado que DA y DB son matrices diagonales, entonces cumplen con que:

DA DB = DB DA = iA iB

Asimismo tanto (*) como (**) implican que la matriz que resulta de

diagonalizar la matriz AB=BA es DA DB , con lo que se verifica que el valor

propio i-simo de AB es igual al producto del valor propio i-simo de A, por el

valor propio i-simo de B.

(b) Sobre la base de sus conceptos de diagonalizacin, verifique que 1 y 2

son valores propios de la matriz A, si se sabe que es de orden 2, y que cumple

la siguiente ecuacin matricial:

A2 + 3A + 2 ( I2 ) =

donde I2 es una matriz identidad de orden 2.

S

OLUCIN

1era forma

Dado que tenemos que usar nuestros conceptos de diagonalizacin, debemos

expresar la matriz A en funcin de la matriz que resulta de diagonalizarla. Es

decir:

A = PDA P1

Incluyendo esta expresin en

adecuadamente:

2

( PDA P1 ) + 2 ( PDA P1 ) 3 ( PP1 )

la

ecuacin

matricial,

factorizando

donde consideramos que PP1 = I2

Tenemos:

2

P ( DA ) + 2 ( DA ) 3I2 P1 =

Dado que P es no singular, entonces, necesariamente:

2

( DA ) + 2 ( DA ) 3I2 =

Donde podemos utilizar la forma de la matriz D para formar dos ecuaciones

con los valores propios::

19

Matemticas para Economistas

Ejercicios resueltos Primer borrador

0

1

+2

2

0

0

1 0

3

=

2

0 1

12 + 21 3 = 0

22 + 22 3 = 0

Ambas ecuaciones cumplen para los valores 1 y 2, pero tenemos que ver que

1 y 2 puede tomar dichos valores, indistinamente. Entonces, tenemos tres

casos:

Valores propios diferentes: 1 = 1 y 2 = 2 viceversa.

1 = 2 = 1 1 = 2 = 2

Valores propios repetidos

2da forma

A partir de la ecuacin matricial inicial, podemos hacer uso de la definicin de

valores y vectores propios:

A2 + 3A + 2 ( I 2 ) =

Premultiplicamos por el vector v:

A2v + 3Av + 2 ( I 2 ) v =

con lo cual la igualdad deja de se en trimnos de matrices, para pasar a ser

una igualdad e vectores (suma de vectores, igual al vector nulo). Dado que:

por lo que

A ( Av ) = ( Av )

A2 v = 2 v

Av = v

Reemplazamos esto, y obtenemos:

2v + 3v + 2v =

+ 3 + 2 ) v =

+ 3 + 2 ) = 0

ahora, dado que v

1 = 1

20

2 = 2

Matemticas para Economistas

Ejercicios resueltos Primer borrador

3.2 Formas cuadrticas y definicin de matrices

3.2.1

Demostraciones

(i) [PC2 2002 I] Sean las matrices Amxm definida positiva, y

rango m, entonces la matriz PAP es tambin definida positiva.

S

Pmxn de

OLUCIN

Definimos un vector cualquier y de dimensin igual a n, de modo tal que

se puede definir el vector Py, resultante de pre-multiplicar la matriz P por

el vector y , de orden mx1.

Considerando que la matriz A es definida positiva (DP), entonces se

cumple que cualquier forma cuadrtica que tiene como matriz de

coeficientes a la matriz A cumplir:

x ' Ax > 0

x Rm

Entonces, si asumimos un x = Py , tendremos que:

(Py ) ' A (Py ) > 0

de aqu que:

y ' P ' APy > 0

que no es otra cosa que otra forma cuadrtica, cuya matriz de coeficientes

es igual a P ' AP , que tiene que ser necesariamente DP, dado que cumple

con la condicin de formas cuadrticas definidas positivas:

y ' ( P ' AP ) y > 0

Por lo tanto, el enunciado es verdadero.

(ii) [PC2 2002 I] Dada la matriz A de dimensin mxn, que tiene sus

columnas linealmente independientes entre s (lo que exige que m n

puesto que las columnas son vectores de dimensin m, y si m < n ,

entonces no podramos tener n vectores independientes). Demostrar que

el producto A ' A es una matriz definida positiva.

S

OLUCIN

La condicin de que Amxn tenga todas sus columnas linealmente

independientes se desprende de la propiedad de que....{ver Hayashi,

Econometrics, apendice}

Definamos un vector x de orden nx1, tal que: Ax = y mx 1

y 'y =

,m

2

i

>0

x ' A ' Ax > 0

i =1

positiva.

21

A ' A es una matriz definida

Matemticas para Economistas

Ejercicios resueltos Primer borrador

(v) [PD3 2003 I] Toda forma cuadrtica se puede expresar como un

polinomio de grado 2; sin embargo, no todo polinomio de grado 2 se puede

expresar como una forma cuadrtica.

S

OLUCIN

En efecto, toda forma cuadrtica es un polinomio de grado 2, que tambin

es homogneo (tiene trminos cuadrticos y cruzados, mas no lineales).

Por lo tanto, una forma cuadrtica es un caso particular de un polinomio

de grado 2.

(vi) [PD3 2003 I] Si Anxn es definida positiva (DP), y Bnxn es semidefinida

positiva (SDP), analiza la verdad o falsedad de las siguientes

afirmaciones:

S

OLUCIN

(i) x ' ( A + B ) x > x ' Ax

Operamos la expresin, pre y post multiplicando el vector x a la matriz

A+B, de tal forma que obtenemos una nica forma cuadrtica:

x ' Ax + x ' Bx > x ' Ax

x ' Bx > 0

Dado que por condicin del problema, la matriz B es SDP, entonces se

cumple que x ' Bx 0 . Por lo tanto, la afirmacin es falsa, puesto que

podra darse el caso en que x ' Bx = 0

(ii) x ' ( A B ) x > 0

Procedemos de igual forma que el caso anterior:

x ' Ax x ' Bx > 0

x ' Ax > x ' Bx

La condicin a la que llegamos se cumplira nicamente si es que si

x ' Bx = 0 , pero dado que x ' Bx 0 , la afirmacin es falsa.

(vii) [PC2 2003 I]Sean las matrices Am x m definida positiva, y Pm

rango m, entonces la matriz P ' AP es tambin definida positiva.

S

x n

de

OLUCIN

La expresin es verdadera. Si A es una matriz definida positiva (DP), de

orden m, entonces toda forma cuadrtica que tenga a dicha matriz como

matriz de coeficientes cumplir: x ' Ax > 0 , para todo vector de variables

x de orden mx1 ( x Rm )

22

Matemticas para Economistas

Ejercicios resueltos Primer borrador

Ahora, si es que la matriz Pn x m ' Am x m Pm x n (de orden n) es tambin DP ,

entonces tambin cumplir que: y ' ( P ' AP ) y > 0 .para cualquier vector y

de orden nx1. Si consideramos esto como cierto, y operamos un poco

llegaremos a que:

y ' P ' APy > 0

(y ' P ' ) A ( Py ) > 0

(Py ) ' A (Py ) > 0

donde la expresin Pmxn ynx 1 es un vector Z de orden mx1. De aqu se

puede ver que en esencia lo que estamos haciendo es z ' Az > 0 para

z Rm , entonces la expresin redunda en la condicin de que A es DP.

(viii) [PC2 2003 II] Sea una matriz cuadrada B de orden n. Si la matriz

simtrica A se puede descomponer como A = BB ' entonces se cumple que

x ' Ax 0 , x Rn .

S

OLUCION

1era alternativa

Si es factible la descomposicin A = BB ' , esto implica que existe la matriz

D 1 / 2 para que B = PD 1 / 2 . Es decir, los valores propios de la matriz

simtrica A deben ser no negativos, por lo que la afirmacin es incorrecta.

Sera no definida negativa, por lo que x ' Ax 0

2da alternativa

Es posible introducir la descomposicin A = BB ' en la forma cuadrtica

en cuestin, tal que x ' ( BB ' ) x 0 ( B ' x ) ' ( B ' x ) 0 donde B ' x = w

es un vector cualquiera. De esta manera la expresin x ' ( BB ' ) x 0

representa el mdulo al cuadrado del vector cualquiera w. Con esto se

verifica que debera ocurrir que x ' ( BB ' ) x 0

(ix) [PC2 2003 II] Si A es una matriz idempotente ( A = A2 ) y simtrica

de orden n tal que: x ' Ax = 0 . Demuestra que si A tiene valores propios

todos 0 , entonces el vector x es necesariamente nulo.

S

OLUCIN

Si A es idemponente, entonces la expresin x ' Ax = 0 es equivalente a

x ' AAx = 0 .Ahora, dado que se tiene la condicin de que A es tambin

simtrica, se cumple que:

x ' AAx = ( Ax ) ' ( Ax ) = 0

Es decir, el vector m = Ax tiene modulo cero (es nulo). Entonces,

Ax = . Dado que A es no singular, podemos premultiplicar ambos

lados por su inversa A1Ax = A1 , lo que implica que x = ,

necesariamente.

(x) [PC2 2003 II] La matriz identidad es una matriz no definida.

23

Matemticas para Economistas

Ejercicios resueltos Primer borrador

OLUCIN

1era alternativa

Sea el vector m Rn y sea la matriz identidad I n de orden n. Entonces

la forma cuadrtica Q = m ' I n m ser igual al producto interno del vector

m: Q = m ' m 0 ( m ' m = 0 puesto que el vector m podra ser igual al

nulo). De esta manera, bajo este anlisis lo nico que se puede concluir es

que la matriz identidad ser, en principio, no definida negativa (o semi

definida positiva).

2da alternativa

Es factible tambin darnos cuenta de que la matriz identidad es diagonal,

por lo que sus elementos son sus mismos valores propios. Dado que son

todos iguales a 1, con este anlisis se llega a que esta matriz es definida

positiva. Ojo que este anlisis no contradice al realizado en la alternativa

1, sino que lo complementa.

(xi) [PC2 2003 II] Sea la forma cuadrtica: Q = v ' Av definida de tal

manera que v es un vector propio de A. Entonces si se desea que Q tome

el mximo valor posible5, este valor ser igual al mayor valor propio de A.

S

OLUCIN

Si v es un vector propio de A entonces se cumple que Av = v , donde

es su correspondiente valor propio asociado. De esta manera,

Q = v ' Av = v ' v = v ' v . Entonces, nicamente en el caso de que los

vectores propios v de la matriz A estn adecuadamente normalizados de

tal manera que su mdulo sea igual a 1, la afirmacin se cumplir puesto

que:

Dado que v ' v = 1

Q = v ' v =

En este caso, el mximo valor que podra adoptar Q es igual al valor

propio mximo. En caso contrario, es decir, si no se da tal normalizacin,

el valor de Q podra incrementarse indefinidamente aumentando

indiscriminadamente el mdulo del vector propio v.

Nota: Evidentemente, para que exista un mximo la funcin que se desea

optimizar debe cumplir una serie de condiciones. Una de ellas, establece

que esta debe ser cncava para que pueda tener un mximo. En este caso,

la forma cuadrtica.{ver Sundaram}

Para esta pregunta no es necesario que utilices tus conceptos de optimizacin, sino nicamente la nocin

de valores y vectores propios.

24

Matemticas para Economistas

Ejercicios resueltos Primer borrador

(xii) [PC2 2004 I] Sean M y N son dos matrices de orden n, cuyos valores

propios son positivos y no-negativos, respectivamente; as, la matriz M+N

ser necesariamente definida positiva.

S

OLUCIN

Si los valores propios de M son todos positivos, entonces M ser una

matriz definida positiva, lo que a su vez implica que toda forma

cuadrtica asociada a M cumplir:

x ' Mx > 0

x R n , x

De la misma manera, la matriz N ser semi-definida negativa, por lo que

se cumple que:

y ' Ny 0

y R n , y

Luego, la matriz M+N si ser definida positiva, puesto que la forma

cuadrtica asociada a M+N verificar necesariamente que:

z '(M + N )z = z ' Mz + z ' Nz = ( > 0 ) + ( 0 ) > 0

(xiii) [PC2 2004 I] Toda forma cuadrtica puede ser re-expresada en

funcin de los vectores propios de su matriz de coeficientes.

S

OLUCIN

x ' Ax > 0 donde x R n . Siempre y cuando A tenga n vectores propios

linealmente independientes (si A es digaonalizable), entonces dichos

vectores propios formarn una base de Rn, y por ende podrn generar a

cualquier x Rn , mediante una combinacin lineal.

Ms an, la forma cuadrtica resultante tendr como matriz de

coeficientes a la matriz diagonalizada de A:

x ' ( PDAP ' ) x = ( P ' x ) ' DA ( P ' x )

x ' Ax > 0

3.2.3

Un teorema

[PC2 2002 II]

Demostrar el siguiente teorema:

Sea A es una matriz simtrica de orden n que tiene vectores propios

asociados

vi i = 1,2... n , con valores propios

i i = 1,2... n que

cumplen:

1 2 n 1 n

Entonces se cumple que:

1

para todo vector x Rn .

x ' Ax

n

x 'x

25

Matemticas para Economistas

Ejercicios resueltos Primer borrador

OLUCIN

Cada valor propio i tiene asociado un vector propio vi. Estos vectores propios

cumplen dos propiedades:

vi ' v j = 0

i j

(condicin de ortogonalidad)

(puesto que A es simtrica y asumo que vi

vi ' vi = 1

i

est normalizado para ser ortonormal)

Dado que por definicin, los vectores propios son linealmente independientes,

stos al ser n vectores generarn al espacio Rn .

X =

a v

X Rn

i i

i =1

De esta manera:

x ' Ax

=

x 'x

( a v ) A (a v )

(a v ) (a v )

i i

i i

i i

(*)

i i

Veamos el segundo trmino del numerador:

n

A ai vi = a1Av1 + a2Av2 +

+ an Avn =

i =1

a v

i

i i

, dado que Avi = i vi

i =1

Volviendo a (*)

x ' Ax

=

x 'x

(a v ) (a v )

(a v ) (a v )

i i

i i

i i

i i

Esto se puede reducir:

(a1v1 '+ a2v2 '+ + an vn ' )(a11v1 + + an n vn )

x ' Ax

=

x 'x

(a1v1 '+ a2v2 '+ + an vn ' ) ( (a1v1 + a2v2 + + an vn ) )

2

x ' Ax (a1 1v1 ' v 1 +a2 1v2 ' v1 +

=

x 'x

(a12v1 ' v1 + a1a2v1 ' v2 +

Dado que vi es ortonormal:

x ' Ax

=

x 'x

1 =

a

a

2

i 1

2

i

a

a

2 =

Entonces:

26

2

i i

2

i

a

a

2

i n

2

i

+ an2 n vn ' vn )

+ an2vn ' vn )

Matemticas para Economistas

Ejercicios resueltos Primer borrador

1 ai2

3.2.4

2

i

2

i i

2

i

2

x ' Ax n ai

=

x 'x

ai2

Lqqd.

Formas cuadrticas restringidas I

[PC2 2001 II]

Dada la siguiente forma cuadrtica

0 0 0 x

(x , y, z ) = [x , y, z ] 0 1 0 y

0 4 1 z

sujeta a la siguiente restriccin:

x ay z = 0

Determine el valor que debe tomar a para que la forma cuadrtica sea

indefinida

S

OLUCIN

TBW

3.2.5

Pregunta de Valores y Vectores Propios

(PC2 2002-II)

Sea la matriz H n n definida de la siguiente manera:

H = (1 )I n + '

Donde I n es una matriz identidad de orden nxn, es un vector suma, y

R se encuentra en el rango 0 < < 1.

a. Halle los valores y vectores propios de H para n=2.

S

OLUCIN

n=2

0

(1 )

H =

+

(1 )

0

Valores priopios:

1

1

=

= (1 ) 2 = [ ( 1 ) ] [ ( 1 ) + ] = 0

2

1 = 1

2 = 1 +

Vectores propios:

Para 1 = 1 :

27

Matemticas para Economistas

Ejercicios resueltos Primer borrador

v11 0

v12 = 0

Para 2 = 1 + :

v21 0

v22 = 0

1

v1 = t

1

1

v2 = w

1

b. A partir de los valores propios indique si la matriz es definida negativa o

definida positiva.

S

OLUCIN

Dado que 1 > 0 2 > 0 , se comprueba que la matriz es definida positiva.

3.2.6

Formas cuadrticas restringidas II

[PC2 2001 II]

6. Dada la forma cuadrtica

1 1

1 3

Q = x 1 x 2 x 3 x 4

2 3

0 7

que esta sujeta a las siguientes restricciones:

x1 x 2 = 0

x 3 3x 4 = 0

Determine cmo est definida Q.

0 x1

3 7 x 2

5 5 x 3

5 1 x 4

OLUCIN

Obtenemos la forma cuadrtica como polinomio (en forma extensiva):

Q ( x 1, x 2 , x 3 , x 4 ) = x 12 + 3x 22 + 5x 32 x 42 2x 1x 2 4x 1x 3 6x 2x 3 + 14x 2x 4 10x 3x 4

Las restricciones nos sirven para reemplazar y reducir el polinomio a dos

variables:

x1 = x 2

x 3 = 3x 4

De tal manera que nos queda:

Q ' ( x 2 , x 4 ) = 2x 22 + 14x 42 16x 2x 4

Matricialmente:

28

Matemticas para Economistas

Ejercicios resueltos Primer borrador

2 8 x 2

x4

8 14 x 4

Q ' ( x 2 , x 4 ) = x 2

Analizando la matriz:

a11 = 2 > 0

8 14

= 28 64 < 0

Por lo tanto, Q es indefinida.

3.2.7

Formas cuadrticas

[PC2 2003 II]

2. Considera un vector x Rn , tal que x ' = x 1 x 2 x n .

Q=

(x

i =1

decir, x =

x ' M0 x .

x)

La expresin

donde x es el promedio de las coordenadas del vector x (es

1 n

x i ),

n i =1

puede ser expresada como una forma cuadrtica de tipo

1

a. Asumiendo n=2, demuestra que: M 0 = I i i ' donde i es un vector

n

suma de dimensin n.

S

OLUCIN

(i) En general, la expresin que debo analizar debe estar en funcin de las

coordenadas del vector x. Por esto, se podra simplificar la expresin inicial

para poner las medias en funcin del vector x:

n

(x

x) =

2

i =1

(x

i =1

2

i

(x

2

i

i =1

2x i x + x 2 ) =

=

=

i =1

2x i x + x 2 )

2x x i + nx

2

i

i =1

1 n n

1 n

x i2 2 x i x i + n x i

i =1

n i =1 i =1

n i =1

n

x i2 2

i =1

1 n

= x xi

n i =1

i =1

n

2

i

(ii)Para n=2

29

1 n

1 n

x

xi

+

i n

n i = 1

i =1

Matemticas para Economistas

Ejercicios resueltos Primer borrador

(x

i =1

1

2

(x1 + x 2 )

n

1

= ( x 12 + x 22 ) ( x 12 + x 22 + 2x 1x 2 )

n

1 2

1

2

= 1 x 1 + 1 x 22 x 1x 2

n

n

x ) = ( x 12 + x 22 )

2

De esta manera, la forma cuadrtica se puede expresar matricialmente como:

x 1

1

1

1 n

x 1

n

x2

1

1 x 2

v

1

n

n

1

1

1 n

1

n

= I ii '

Donde M 0 =

1

1

n

n

n

Notemos que debo tratar de ponerlo como una suma de la identidad mas otra

matriz. Haciendo esto, nos queda que:

1 0

M0 =

0 1

1

n

1

1

n

1

n

1 0 1 1 1

M0 =

0 1 n 1 1

1 1

Lo que comprueba el enunciado, puesto que es directo que i i ' =

.

1 1

b. Verifica que M 0 es semi-definida positiva.

S

OLUCIN

1era alternativa

La forma generalizada de la matriz M 0 es:

30

Matemticas para Economistas

Ejercicios resueltos Primer borrador

1

1

1

n

n

n

1 0 0

1 1 1

1

1

1

0 1 1 1

1

1

0 1

n

n

n

M0 =

0 0 1

1 1 1

1

1

n

n

n

1

1

1 n

1n

1

1 1

1

M0 =

= U *

n

n

1

1

1 n

Aqu podemos aplicar dos propiedades. En primer lugar, la propiedad de que

los valores propios de la matriz kA son iguales a los valores propios de la

matriz A multiplicados por el escalar k. En segundo lugar, del ejercicio 1

queda claro que (n-1) valores propios de la matriz U* sern iguales a n con

excepcin de 1 que ser igual a 0. De esta manera, para el caso de la matriz

M 0 , (n-1) de sus valores propios sern iguales a 1 y uno de ellos (el ensimo)

ser igual a 0. Con ello se verifica que ser semi-definida positiva.

2da alternativa

Para que la matriz M 0 sea semi-definida negativa, debe ocurrir que toda

forma cuadrtica relacionada a sta es mayor o igual a cero. Es decir:

x ' M 0x 0 . Podemos verificar esto, de varias maneras. Una forma general

ser considerar:

1

1

x ' M 0x = x ' I i i ' x = x ' x x ' (ii ' ) x

n

n

Ahora, podemos considerar que:

(i) x ' x =

2

i

(ii) x ' i = i ' x =

i =1

i =1

Con esto nos queda que:

n

x ' M0x = xi2

i =1

n

1 n

x

i xi

n i =1 j =1

Para n=2

x 12 + x 22

1 2

x 1 + x 22 + 2x 1x 2 0

2

Multiplicando todo por 2 (la desigualdad no varia)

2

lo cual es una proposicin cierta.

x 12 + x 22 2x 1x 2 = ( x 1 x 2 ) 0

Para n=3

31

Matemticas para Economistas

Ejercicios resueltos Primer borrador

1 2

x 1 + x 22 + x 32 + 2x 1x 2 + 2x 1x 3 + 2x 2x 3 0

3

Multiplicando todo por 3:

2x 12 + 2x 22 + 2x 32 2x 1x 2 2x 1x 3 2x 2x 3 =

x 12 + x 22 + x 32

= ( x 12 2x 1x 2 + x 22 ) + ( x 12 2x 1x 3 + x 32 ) + ( x 22 2x 2x 3 + x 32 )

= (x1 x 2 ) + (x1 x 3 ) + (x 2 x 3 )

2

= ( 0) + ( 0) + ( 0) 0

lo cual verifica lo que queramos mostrar.

En general, para cualquier n se puede verificar que se va cumplir que:

n

n

1 n

x ' M 0x = x i2 x i x i

n i =1 j =1

i =1

(n 1) x 12 + (n 1) x 22 + + (n 1) x n2 2x 1x 2 2x 1x 3 asi sucesivamente

esto se puede agrupar de tal manera que:

n

n 2

+

+

x

2

x

x

x

n

3

x i2 = [ 0] + { 0} 0 siempre!

(

)

(

)

i

i j

j

i =1

i j

3era alternativa

Esta matriz es la famosa matriz M que es bastante utilizada en econometra.

Si haban llevado el curso de introduccin tal vez la conocan, y es que M 0 es

la matriz M asociada con el intercepto en un modelo lineal, y aquella que

aplicada a cada variable, la transforma en desviaciones respecto de su media.

Esta matriz M es idemponente, y como tal (como puede verse en la solucion

alternativa 1) nicamente tiene valores propios que pueden ser 0 1.

3.2.8

Desigualdad de Schwartz

[PC2 2004 I]

La desigualdad de Schwartz (1885) establece que, para dos vectores no nulos x

e y del espacio Rn , se cumple que: ( x ' y ) ( x ' x ) ( y ' y ) .

2

a. Verifique que para toda matriz A de orden nxm (con n>m), la matriz AA

tiene valores propios no negativos.

S

OLUCIN

Si la matriz tiene valores propios no negativos, entonces o los que tiene son

ceros (algunos de ellos) o son poaitivos. De esta manera, o bien la matriz AA

es definida positiva (DP) o es semi-definida positiva.

(i) Definida Positiva

Implica que y ' ( A ' A) y = ( Ay ) ' ( Ay ) > 0 , es decir, que el vector Ay

32

Matemticas para Economistas

Ejercicios resueltos Primer borrador

(ii) Semi-Definida Positiva

Implica que y ' ( A ' A) y = ( Ay ) ' ( Ay ) 0 , es decir, que puede ocurrir que

Ay = , dejando de lado la posibilidad de que y = , solo cuando ( A ' A )

no exista6, lo cual implica que A ' A no es invertible, es decir det( A ' A )=0 o

lo que es lo mismo, uno de sus valores propios debe ser igual a cero.

Por lo tanto, lo que se verifica aqu es que la matriz A ' A es DP o SDP.

1

b. Considere una matriz de nx2 (con n>2) cuyas columnas son los vectores x e

y, tal que A = x y . Sobre la base de su respuesta en a., y del concepto

de definicin de matrices, demuestre la desigualdad de Schwartz.

S

OLUCIN

La matriz A tendr la siguiente forma:

x 1 y1

x 2 y2

A=

A = x nx 1 y

nx 1

x n yn

De modo que la matriz A se puede expresar como:

x '1xn

x 1 x 2 x n

A' =

A ' = y y y

y'

2

n

1

1xn

Con esta notacin abreviada obtenemos la expresin para AA:

x '1xn

x ' x x ' y

A' A =

x nx 1 y nx 1 =

nx 2

y'

y 'x y 'y

1xn 2xn

2x 2

(*)

Dado que sabemos que AA es DP o SDP, debemos de considerar las

condiciones que debe cumplir en cada caso. Para ello tenemos tres

alternativas:

(i) Evaluar la forma cuadrtica asociada a la matriz AA

(ii) Evaluar sus valores propios.

(iii) Evaluar sus menos complementarios, que en este caso seran nicamente

dos, puesto que es una matriz de 2x2.

De estas alternativas, tenemos que ver cul es la que nos permite

aproximarnos a la expresin que queremos demostrar:

2

( x ' y ) (x ' x ) (y ' y )

Si

( A ' A)1

existe, entonces

A ' Ay =

implica que

una forma cuadrtica.

33

y = , lo cual contradice la generalidad de

Matemticas para Economistas

Ejercicios resueltos Primer borrador

Luego de un breve anlisis de la expresin (*), podemos darnos cuenta que la

mejor alternativa sera la exploracin de la alternativa (iii). En este caso, dado

que AA es DP o SDP, entonces:

Primer menor: x ' x 0 , que es verdad, por cuanto x es un vector no nulo (es

decir, se cumple con desigualdad estricta.

Segundo menor (que equivale al determinate de la matriz AA):

A ' A = ( x ' x ) ( y ' y ) ( x ' y )( y ' x )

Dado que ( x ' y ) = ( y ' x ) , que son nmeros (vectores de 1x1), podemos

expresar el determinante como:

2

A ' A = (x ' x ) (y ' y ) (x ' y )

Dado que AA es DP o es SDP, entonces

2

A ' A = (x ' x ) (y ' y ) (x ' y ) > 0

si es DP

A ' A = (x ' x ) (y ' y ) (x ' y ) 0

2

si es SDP

Como contemplamos ambas alternativas, la segunda expresin es ms general,

por lo que :

2

( x ' y ) ( x ' x ) ( y ' y ) lqqd.

c. Sea Q una matriz simtrica y definida positiva. Sobre la base de las

propiedades de la diagonalizacin de matrices simtricas, demuestre que la

siguiente generalizacin de la desigualdad de Schwartz se cumple:

2

( x 'Qy ) ( x 'Qx ) ( y 'Qy )

Solucin

La expresin de la desigualdad de Schwartz relaciona los mdulos y los

productos internos cruzados de dos vectores. Es decir, est definida para

vectores. Lo que debemos de hacer es tratar de reexpresar esta expresin, en

funcin a ciertos vectores.

Para ello hay que tener en cuenta que, dado que Q es simtrica y definida

positiva:

(i) Q puede cumplir con la descomposicin ortogonal, es decir

DQ = PQP 1 = PQP ' , siempre y cuando asumamos que la matriz P est

formada por los vectores propios de Q, adecuadamente normalizados para ser

ortonormales (es decir P es ortogonal).

(ii) Al tener se definida positiva, es decir, tener todos sus valores propios

positivos, puede descomponerse como Q=CC, lo que constituye la

descomposicin de Cholesky.

De esta manera:

34

Matemticas para Economistas

Ejercicios resueltos Primer borrador

( x ' (CC ' ) y )

( x ' (CC ' ) x ) ( y ' (CC ' ) y )

Reordenando adecuadamente los trminos:

(C ' x ) ' (C ' y ) [(C ' x ) ' (C ' x )] (C ' y ) ' (C ' y )

Si consideramos que: x * = (C ' x )

y * = (C ' y ) , entonces:

2

x

*

'

y

*

(

) (x * ' x *)(y * ' y *)

que es la misma expresin de la desigualdad de Schwartz.

35

Matemticas para Economistas

Ejercicios resueltos Primer borrador

3.3 Otros temas de algebra matricial

3.3.1

Particiones

[PC2 2002 I]

Sea la matriz A, particionada de la forma:

A11 A12

A=

A21 A22

tal que A21 = A12 = . Demostrar que:

det(A) = Gii

i =1

donde Gii son los elementos de la diagonal de la matriz G que resulta de

multiplicar las matrices diagonalizadas de A11 y A22 . (es decir

G =

S

{(P

A11P1 )( P21A22P2 ) )

1

1

OLUCIN

3.2.2

Las Formas Cuadrticas Particionadas

[PC2 2002 II]

Muestre que si la forma cuadrtica x ' Ax se trabaja de modo tal que se

particiona la matriz de coeficientes A en n sub-matrices cuadradas distintas de

igual orden, es posible rescribirla como la suma de p = n (1 / 2) (sub) formas

cuadrticas, propiamente dichas, ms q polinomios no lineales de grado 1,

donde q se define como:

p 1

q = 2 i

i =1

Ayuda: Pruebe con valores para n y luego obtenga una generalizacin. Sea

consistente.

SOLUCIN

Consideremos la siguiente forma cuadrtica: x ' Ax

Evidentemente la matriz de coeficiente de una forma cuadrtica x ' Ax es

siempre cuadrada, por lo que su particin en submatrices de igual orden,

implica que sean divididas en 4,9,16,25, etc. Es decir, n (el nmero de

submatrices) puede ser igual al cuadrado de los nmero naturales enteros.

Para n=4

A11

x 1 ' x 2 '

A21

A21 x 1

= x 1 ' A11 x 1 + x 2 ' A22 x 2 + x 1 ' A12 x 2 + x 2 ' A21 x 1

A22 x 2

en donde los trminos cruzados x 1 ' A12 x 2 y x 2 ' A21 x 1 son equivalentes. Por

esta razn, la expresin anterior se puede reescribir como:

36

Matemticas para Economistas

Ejercicios resueltos Primer borrador

A11

x 1 ' x 2 '

A21

En donde tenemos:

2 formas cuadrticas

1 polinomio de grado 2

A21 x 1

= x 1 ' A11 x 1 + x 2 ' A22 x 2 + 2x 1 ' A12 x 2

A22 x 2

p= n = 2

q=2(1)=2

Para n=9

A11

x 1 ' x 2 ' x 3 ' A21

A31

A12

A22

A32

En donde tenemos:

3 formas cuadrticas

3 polinomio de grado 2

A31 x 1

A32 x 2 = x 1 ' A11 x 1 + x 2 ' A22 x 2 + x 3 ' A33 x 3 +

A33 x 3

+ 2x 1 ' A12 x 2 + 2x 1 ' A13 x 3 + 2x 2 ' A23 x 3

p= n = 3

q=2(1+2)=6

Para n=16

A11 A12 A31 A43 x 1

A21 A22 A32 A43 x 2

x 1 ' x 2 ' x 3 ' x 4 '

A31 A32 A33 A43 x 3

A A

A43 A44 x 4

42

41

= x 1 ' A11 x 1 + x 2 ' A22 x 2 + x 3 ' A33 x 3 + x 4 ' A44 x 4 +

+2x 1 ' A12 x 2 + 2x 1 ' A13 x 3 + 2x 1 ' A14 x 4 + 2x 2 ' A24 x 4 + 2x 2 ' A23 x 3 + 2x 3 ' A34 x 4

En donde tenemos:

4 formas cuadrticas

12 polinomios de grado 2

p= n = 3

q=2(1+2+3)=12

Habiendo establecido una generalidad de casos....

3.3.2

Matrices mgicas

[PC2 2001 II]

Una matriz mgica es aquella matriz de orden n 3 , formada por nmeros

del 0 a n2, que tiene la particularidad de que uno de sus valores propios, y la

suma de los elementos de cada una de sus columnas, de cada una de sus

filas, y de su diagonal, es el mismo valor (al que vamos a llamar por esta vez,

su valor mgico o VM).

(i) Si A es una matriz mgica de orden 3, que cumple que VM(A) = 15,

demostrar que la matriz

37

Matemticas para Economistas

Ejercicios resueltos Primer borrador

M = AI

donde I es la identidad de orden t, es una matriz cuasi-mgica cuyo VQM

(valor cuasi-mgico) para filas y columnas (nicamente) es tambin 15, pero

que la suma de su diagonal es 15t.

(ii) Se sabe que si la matriz mgica

17

23

M = 4

10

11

M, de orden 5:

24 1 8 15

5 7 14 16

6 13 20 22

12 19 21 3

18 25 2 9

se diagonaliza, el resultado es la matriz DM:

0

0

0

0

65

0

0

0

0 22.5471

0

21.6874

0

0

DM = 0

0

0

0

14.4036

0

0

0

0

11.9008

0

Hallar el determinante de la inversa de la matriz:

0

34

0

46

0

8

0

20

0

22

3.3.3

34

0

46

0

8

0

20

0

22

0

0

48

0

10

0

12

0

24

0

36

48

0

10

0

12

0

24

0

36

0

0

2

0

14

0

26

0

38

0

50

2

0

14

0

26

0

38

0

50

0

0

16

0

28

0

40

0

42

0

4

16

0

28

0

40

0

42

0

4

0

0

30

0

32

0

44

0

6

0

18

30

0

32

0

44

0

6

0

18

0

El modelo lineal general

[PC2 2001 II]

Un poco de teora:

(1) El Modelo Lineal General en breve

En econometra, el Modelo Lineal General viene dado por la siguiente sistema

de ecuaciones:

ynx 1 = X nxk kx 1 + enx 1

38

Matemticas para Economistas

Ejercicios resueltos Primer borrador

y1

x 11 x 12 x 1k

y2

x 21 x 22 x 2k

=

yn nx 1 x n 1 x n 2 x nk nxk

1

e1

e2

2

+

en

k

kx 1 nx 1

de modo que la solucin para obtener los coeficientes (solucin del modelo),

es que stos minimicen la suma de los errores estimados (vector e) del modelo.

As, la solucin a la minimizacin:

n

Min ei2 = y x y x

es = ( X ' X ) ( X ' y ) .

1

i =1

)(

(2) La Matriz de Proyeccin Ortogonal

Sea una matriz cualquiera H, no singular, de orden p la matriz M, tambin de

orden p se denomina matriz de proyeccin ortogonal de H si:

1

M = I H ( H H ) H

de modo que H ' M = .

Por particularidades de su investigacin, a Ud. le resulta ms fcil trabajar

con la matriz X (de k variables) en forma particionada, de modo que X puede

ser re-expresada como la particin de dos grupos de variables X = X1 X 2

donde X1 es de orden nxk1 (k1 variables) y X2 es de orden nxk2 (k2 variables),

de modo que ahora se estiman simultneamente 2 grupos de coeficientes

( k = k1 + k2 ):

1

= .

2

(i) Muestre que los valores estimados de 1 se expresan en funcin de la matriz

de proyeccin ortogonal de X2 (es decir, M2), y 2 en funcin de la matriz de

proyeccin ortogonal de X1 (es decir, M1).

S

OLUCIN

(ii) Demuestre que los valores propios de M1 son iguales a los valores propios

de M2 e iguales a 1 y 0.

S

OLUCIN

39

S-ar putea să vă placă și

- Metodos FactorizaciónDocument10 paginiMetodos Factorizaciónprofe.alex60% (10)

- Ecuaciones de Grado SuperiorDocument2 paginiEcuaciones de Grado SuperiorJesus GutierrezÎncă nu există evaluări

- Presentación Métodos Numéricos Por InterpolaciónDocument22 paginiPresentación Métodos Numéricos Por InterpolaciónFabian Colque ZegarraÎncă nu există evaluări

- Actividad de Puntos Evaluables - Escenario 6 - PRIMER BLOQUE-CIENCIAS BASICAS - METODOS NUMERICOS - (GRUPO1)Document4 paginiActividad de Puntos Evaluables - Escenario 6 - PRIMER BLOQUE-CIENCIAS BASICAS - METODOS NUMERICOS - (GRUPO1)Alejandro JiménezÎncă nu există evaluări

- Unidad IV TareaDocument2 paginiUnidad IV TareaRafael Ramírez MedinaÎncă nu există evaluări

- Caso de EstudioDocument10 paginiCaso de EstudioDeniss ArenivasÎncă nu există evaluări

- Plan Lector 1 Ecuaciones DiferencialesDocument5 paginiPlan Lector 1 Ecuaciones DiferencialesValeria MartinezÎncă nu există evaluări

- Clase 8. Método de Sylvester IMTDocument4 paginiClase 8. Método de Sylvester IMTLOPEZ SANCHEZ ROBERTOÎncă nu există evaluări

- Trabajo de Investigacion Analisis NumericoDocument13 paginiTrabajo de Investigacion Analisis NumericoNathaly Marcela Amaya AgredaÎncă nu există evaluări

- Taller de Regla de Cramer y Metodo de Gaus - Jordan .Document9 paginiTaller de Regla de Cramer y Metodo de Gaus - Jordan .Ruby Yamile COSSIO MOSQUERAÎncă nu există evaluări

- Marco Tigre - Métodos Númericos AvanzadosDocument3 paginiMarco Tigre - Métodos Númericos AvanzadosMarco TigreÎncă nu există evaluări

- Determinacion Del Caudal de Un RioDocument15 paginiDeterminacion Del Caudal de Un RioRoberto E Rodas RenquifoÎncă nu există evaluări

- à - Rea Momento - Portico1 - GuiaDocument10 paginià - Rea Momento - Portico1 - GuiaDayron TorradoÎncă nu există evaluări

- Modelos, Computadoras y Análisis Del Error PDFDocument19 paginiModelos, Computadoras y Análisis Del Error PDFSheifry MartinezÎncă nu există evaluări

- Capítulo 2 TEXTO NUEVO DefDocument123 paginiCapítulo 2 TEXTO NUEVO DefSonia Alexandra Echeverria YánezÎncă nu există evaluări

- Sistema de Ecuaciones Lineales 3x3 Ej 1Document2 paginiSistema de Ecuaciones Lineales 3x3 Ej 1CANEKEDÎncă nu există evaluări

- Investigación de OperacionesDocument13 paginiInvestigación de OperacionesMiguel HernándezÎncă nu există evaluări

- Por Reducción X+y+z 2 2x-Y+2z 1 3x+2y 2z 10Document6 paginiPor Reducción X+y+z 2 2x-Y+2z 1 3x+2y 2z 10vanesa londoñoÎncă nu există evaluări

- Cap 3Document39 paginiCap 3Hernan Kennedy Ricaldi PorrasÎncă nu există evaluări

- Factorizacion LUDocument2 paginiFactorizacion LUPaulina TejadaÎncă nu există evaluări

- Ficha 03 Polinomios I GradosDocument12 paginiFicha 03 Polinomios I GradosDARIO ASTETE DAVALOSÎncă nu există evaluări

- 5 Factorizacion de PolinomiosDocument17 pagini5 Factorizacion de PolinomiosleoastorsÎncă nu există evaluări

- Universidad Autónoma Del Estado de Hidalgo: Instituto de Ciencias Básicas E IngenieríaDocument11 paginiUniversidad Autónoma Del Estado de Hidalgo: Instituto de Ciencias Básicas E IngenieríaIan Roberto AlvaradoÎncă nu există evaluări

- Sistema de Ecuaciones Lineales Es UnDocument10 paginiSistema de Ecuaciones Lineales Es UnOriana MontenegroÎncă nu există evaluări

- Act. - 1.1 - PradoArellanoDocument6 paginiAct. - 1.1 - PradoArellanoUli PradoÎncă nu există evaluări

- Entrega Semana 3 Metodos Numericos Entrega Semana 3 Metodos NumericosDocument16 paginiEntrega Semana 3 Metodos Numericos Entrega Semana 3 Metodos NumericosAndres RodriguezÎncă nu există evaluări

- 0 Introduccion Metodos Aproximados en Ing Quimica USB Profesor Rafael Benitez Practicas PDFDocument17 pagini0 Introduccion Metodos Aproximados en Ing Quimica USB Profesor Rafael Benitez Practicas PDFRaul VelloÎncă nu există evaluări

- Ficha 6 Ecuaciones LinealesDocument2 paginiFicha 6 Ecuaciones LinealesMillones Chirinos Max IsraelÎncă nu există evaluări

- Sesión 7 Interpolación Diferenciable - PythonDocument8 paginiSesión 7 Interpolación Diferenciable - PythonjoseÎncă nu există evaluări

- Método en MatlabDocument122 paginiMétodo en MatlabRoiverLagaresÎncă nu există evaluări