Documente Academic

Documente Profesional

Documente Cultură

Arboles de Regresion Ejemplo 2016-2017

Încărcat de

Charo PradosDrepturi de autor

Formate disponibile

Partajați acest document

Partajați sau inserați document

Vi se pare util acest document?

Este necorespunzător acest conținut?

Raportați acest documentDrepturi de autor:

Formate disponibile

Arboles de Regresion Ejemplo 2016-2017

Încărcat de

Charo PradosDrepturi de autor:

Formate disponibile

Aprendizaje

Automático

1/ 19

Tutora:

Àngela Martín

Ejemplo

Generar árbol de

Técnicas inductivas mixtas

Regresión

Parámetros ω y τ Árboles de Regresión. M5

Cálculo de τ

Generar subarbol

Árbol final

Ejemplo

Tutora: Àngela Martín

10-11-2016

Tutora: Àngela Martín Aprendizaje Automático (UNED) 1/ 19

10-11-2016 1 / 19

Indice

Aprendizaje

Automático

2/ 19

Tutora:

Àngela Martín

Ejemplo

Generar árbol de

1 Ejemplo

Regresión

Parámetros ω y τ

Generar árbol de Regresión

Cálculo de τ Parámetros ω y τ

Generar subarbol

Árbol final

Cálculo de τ

Generar subarbol

Árbol final

Tutora: Àngela Martín Aprendizaje Automático (UNED) 2/ 19

10-11-2016 2 / 19

Indice

Aprendizaje

Automático

3/ 19

Tutora:

Àngela Martín

Ejemplo

Generar árbol de

1 Ejemplo

Regresión

Parámetros ω y τ

Generar árbol de Regresión

Cálculo de τ Parámetros ω y τ

Generar subarbol

Árbol final

Cálculo de τ

Generar subarbol

Árbol final

Tutora: Àngela Martín Aprendizaje Automático (UNED) 3/ 19

10-11-2016 3 / 19

Tabla de ejemplos

Aprendizaje

Automático

4/ 19

Tutora: La fila i, i = 1.,7 representa que una persona que haga ejercicio

Àngela Martín

(Si/No), su alimentacion sea saludble (Si/No), tome alcohol

Ejemplo

(Si/No) y tenga sobrepeso (Si/No), la tasa de colesterol será la

Generar árbol de

Regresión

correspondiente al valor de la columna Colesterol que es la

Parámetros ω y τ

Cálculo de τ

clase.

Generar subarbol

Árbol final

Ej. Ejercicio Alimentacion Alcohol Sobrepeso Colesterol

(A1 ) saludable (A2 ) (A3 ) (A4 ) (Clase)

1 Si Si No No 200

2 Si Si Si No 250

3 No No Si Si 400

4 Si No No No 290

5 Si No Si No 300

6 No No No Si 450

7 Si Si No Si 220

Tutora: Àngela Martín Aprendizaje Automático (UNED) 4/ 19

10-11-2016 4 / 19

Aprendizaje

Automático

5/ 19

Tutora:

Àngela Martín

Calculo de la media de los valores de los atributos

Ejemplo

Generar árbol de

Regresión

200 + 250 + 290 + 300 + 220

Parámetros ω y τ

µA1 =Si = = 252

Cálculo de τ

Generar subarbol

5

Árbol final

400 + 450

µA1 =No = = 425

2

Tutora: Àngela Martín Aprendizaje Automático (UNED) 5/ 19

10-11-2016 5 / 19

Aprendizaje

Automático

6/ 19 Cálculo de la desviación típica de los atributos

Tutora: v

Àngela Martín u n

u 1 X

σ=t (x − x )2

Ejemplo n − 1 i=1

Generar árbol de

Regresión

Parámetros ω y τ siendo x la media de los valores de los atributos y n la cantidad

Cálculo de τ

Generar subarbol de ejemplos para cada uno de los dos valores diferentes en el

Árbol final

dominio de A1 .

p

σA1 =Si = (200 − 252)2 + (250 − 252)2 + (290 − 252)2 + (300 − 252)2 + (220 − 252)2 = 86, 48

p

σA1 =No = (400 − 425)2 + (450 − 425)2 = 35, 35

Tutora: Àngela Martín Aprendizaje Automático (UNED) 6/ 19

10-11-2016 6 / 19

Aprendizaje

Automático

7/ 19

Tutora:

Àngela Martín

Calculo del error ponderado de A1

Ejemplo

Generar árbol de

Regresión

5

Parámetros ω y τ

ErrorA1 =Si = × 86, 48 = 61, 67

Cálculo de τ

Generar subarbol

7

Árbol final

2

ErrorA1 =No = × 35, 35 = 10, 10

7

Tutora: Àngela Martín Aprendizaje Automático (UNED) 7/ 19

10-11-2016 7 / 19

Aprendizaje

Automático

8/ 19

Tutora: Calculo error total

Àngela Martín

Ejemplo

Generar árbol de

ErrortotalA1 = 61, 67 + 10, 10 = 71, 77

Regresión

Parámetros ω y τ

Cálculo de τ Hacemos lo mismo con el resto de los atributos: A2 , A3 y A4

Generar subarbol

Árbol final

ErrortotalA2 = 92, 33

ErrortotalA3 = 158, 54

ErrortotalA4 = 119, 5

Tutora: Àngela Martín Aprendizaje Automático (UNED) 8/ 19

10-11-2016 8 / 19

Generar árbol de regresión

Aprendizaje

Automático

9/ 19

Tutora:

Àngela Martín

Selección del nodo raiz

Ejemplo

El mejor atributo es A1 ya que es el que tiene menor error. Por

Generar árbol de

Regresión

tanto, se crea un nodo raiz que se distingue por este atributo y

Parámetros ω y τ

Cálculo de τ

que tiene dos sucesores etiquetados con los valores Si y No:

Generar subarbol

Árbol final

Tutora: Àngela Martín Aprendizaje Automático (UNED) 9/ 19

10-11-2016 9 / 19

Parámetros ω y τ

Aprendizaje

Automático

10/ 19

Tutora:

Sucesores del nodo raiz (A1 )

Àngela Martín

Necesitamos definir ω y τ .

Ejemplo ω indica el mínimo número de ejemplos del conjunto

Generar árbol de

Regresión inicial que debe de tener un nodo para seguir

Parámetros ω y τ

Cálculo de τ

subdividiendose. Generalmente se escoge ω > 3.

Generar subarbol

Árbol final M5 no divide un nodo si tiene pocos ejemplos (en este

caso menos de 4). Weka utiliza ω = 4. No obstante, no se

puede dividir un nodo si la desviación estandar de los

valores de la Clase de los ejemplos que concurren en el

nodo no supera el 5 % de la desviación estandar del

conjunto de ejemplos inicial (τ ).

Tutora: Àngela Martín Aprendizaje Automático (UNED) 10/10-11-2016

19 10 / 19

Cálculo de τ

Aprendizaje

Automático

11/ 19

Tutora:

Àngela Martín Cálculo de τ

Ejemplo

Generar árbol de

Regresión 200 + 250 + 400 + 290 + 300 + 450 + 220

Parámetros ω y τ µClase = = 301, 42

Cálculo de τ 7

Generar subarbol

Árbol final

σClase = 224, 36

τ = 224, 36 ∗ 0, 05 = 11, 21

Tutora: Àngela Martín Aprendizaje Automático (UNED) 11/10-11-2016

19 11 / 19

Aprendizaje

Automático

12/ 19

Tutora:

Àngela Martín

Ejemplos cubiertos por cada valor de los atributos

n

Si =⇒ (1, 2, 4, 5, 7)

A1 = (1)

Ejemplo No =⇒ (3, 6)

Generar árbol de

Regresión

Parámetros ω y τ

n

Si =⇒ (1, 2, 7)

Cálculo de τ A2 = (2)

No =⇒ (3, 4, 5, 6)

Generar subarbol

Árbol final

n

Si =⇒ (2, 3, 5)

A3 = (3)

No =⇒ (1, 4, 6, 7)

n

Si =⇒ (3, 6, 7)

A4 = (4)

No =⇒ (1, 2, 4, 5)

Tutora: Àngela Martín Aprendizaje Automático (UNED) 12/10-11-2016

19 12 / 19

Generar subarbol

Aprendizaje

Automático

13/ 19

Tutora:

Àngela Martín

Ejemplo Tabla de los ejemplos (1,2,4,5,7)

Generar árbol de

Regresión Ej. Ejercicio Alimentacion Alcohol Sobrepeso Colesterol

Parámetros ω y τ (A1 ) saludable (A2 ) (A3 ) (A4 ) (Clase)

Cálculo de τ 1 Si Si No No 200

Generar subarbol 2 Si Si Si No 250

Árbol final 4 Si No No No 290

5 Si No Si No 300

7 Si Si No Si 220

Tutora: Àngela Martín Aprendizaje Automático (UNED) 13/10-11-2016

19 13 / 19

Aprendizaje

Automático

14/ 19

Tutora: Calculo errores totales

Àngela Martín

Calculamos el error total de los tes atributos del modelo reducido.

Ejemplo

Generar árbol de

Regresión

Parámetros ω y τ

σA2 =Si = 35, 59 , σA2 =No = 35, 35

Cálculo de τ

Generar subarbol

ErrortotalA2 = 35, 49

Árbol final

σA3 =Si = 35, 35 , σA3 =No = 66, 84

ErrortotalA3 = 54, 3

σA4 =Si = 0 , σA4 =No = 78, 74

ErrortotalA4 = 62, 99

Tutora: Àngela Martín Aprendizaje Automático (UNED) 14/10-11-2016

19 14 / 19

Aprendizaje

Automático

15/ 19

Tutora:

Àngela Martín

El mejor atributo es A2 ya que es el que tiene menor error y

supera el valor de τ que era 11,21. Por tanto se crea el hijo

Ejemplo izquierdo del nodo raiz.

Generar árbol de

Regresión

Parámetros ω y τ

Cálculo de τ

Generar subarbol

Árbol final

Tutora: Àngela Martín Aprendizaje Automático (UNED) 15/10-11-2016

19 15 / 19

Árbol final

Aprendizaje

Automático

16/ 19

Tutora:

Àngela Martín

Tabla de los ejemplos (1,2,4,5,7) para los atributos A2 A3 y A4

Ejemplo

Generar árbol de

Generamos el subarbol del nodo A2 procediendo de la misma

Regresión

Parámetros ω y τ

manera que para el caso anterior y nos queda la siguiente tabla:

Cálculo de τ

Generar subarbol Ej. Alimentación Alcohol Sobrepeso Colesterol

Árbol final (A2 ) (A3 ) (A4 ) (Clase)

1 Si No No 200

2 Si Si No 250

4 No No No 290

5 No Si No 300

7 Si No Si 220

Tutora: Àngela Martín Aprendizaje Automático (UNED) 16/10-11-2016

19 16 / 19

Aprendizaje

Automático

17/ 19

Tutora:

Como hemos cogido una ω > 3 ya no podemos continuar gene-

Àngela Martín

rando subarboles puesto que ninguno de los nodos tiene más de

tres de los ejemplos del conjunto original. El arbol resultante es

Ejemplo

Generar árbol de

el siguiente:

Regresión

Parámetros ω y τ

Cálculo de τ

Generar subarbol

Árbol final

Tutora: Àngela Martín Aprendizaje Automático (UNED) 17/10-11-2016

19 17 / 19

Aprendizaje

Automático

18/ 19

Con este árbol vemos que la tabla de ejemplos iniciales ha sido

Tutora:

clasificada en tres grupos que son los formados por los ejemplos

Àngela Martín

que caen en cada una de las hojas. Ahora, se debería generar un

modelo de regresión lineal para cada nodo del árbol utilizando

Ejemplo

Generar árbol de

la ecuación vista en la introducción y que es:

Regresión

Parámetros ω y τ

Cálculo de τ a

X

Generar subarbol

Árbol final

Ci = α0 + αj × Aij

j=1

El segundo paso (segunda búsqueda) intenta simplificar el

árbol de regresión generado, borrando de los modelos linea-

les los atributos que no incrementan en error estimado de

clasificación.

Tutora: Àngela Martín Aprendizaje Automático (UNED) 18/10-11-2016

19 18 / 19

Aprendizaje

Automático

19/ 19

Tutora:

Àngela Martín

El tercer paso (tercera búsqueda) trata de reducir el árbol

Ejemplo (podarlo) sin que pierda propiedades. El árbol resultante

Generar árbol de

Regresión separa los ejemplos de entrenamiento dependiendo de su

Parámetros ω y τ

Cálculo de τ

clase y tiene asociado en cada nodo un modelo lineal que

Generar subarbol

Árbol final

calcula el valor de la clase dependiendo del valor de los

atributos que intervienen en el modelo.

Las dos últimas búsquedas se pueden hacer juntas y de este

modo solo se recorre el árbol una vez.

Tutora: Àngela Martín Aprendizaje Automático (UNED) 19/10-11-2016

19 19 / 19

S-ar putea să vă placă și

- Prueba Parcial 1 Estadística 1 ESPE 201720Document1 paginăPrueba Parcial 1 Estadística 1 ESPE 201720JaimeCedeñoÎncă nu există evaluări

- Guión Práctica de Administración Del Perfil Del ContratanteDocument3 paginiGuión Práctica de Administración Del Perfil Del ContratanteCharo PradosÎncă nu există evaluări

- Módulo 1 Introducción A La PLACSPDocument61 paginiMódulo 1 Introducción A La PLACSPCharo PradosÎncă nu există evaluări

- ENS Mod2 PrincipiosbasicosDocument21 paginiENS Mod2 PrincipiosbasicosCharo PradosÎncă nu există evaluări

- Módulo 2 Gestión Del Órgano de AsistenciaDocument35 paginiMódulo 2 Gestión Del Órgano de AsistenciaCharo PradosÎncă nu există evaluări

- Bolso Crochet 2Document6 paginiBolso Crochet 2Charo PradosÎncă nu există evaluări

- Normativa General Provisional Fag 04092023Document18 paginiNormativa General Provisional Fag 04092023Charo PradosÎncă nu există evaluări

- Navidad Foami5Document81 paginiNavidad Foami5Charo PradosÎncă nu există evaluări

- Plantilla Definicion Proceso Peticic3b3n de ServicioDocument7 paginiPlantilla Definicion Proceso Peticic3b3n de ServicioCharo PradosÎncă nu există evaluări

- 3-Modelo de Indice Proyecto de InvestigacionDocument2 pagini3-Modelo de Indice Proyecto de InvestigacionCharo PradosÎncă nu există evaluări

- Definición de Un Catálogo de Servicios de Información Basados en La Web SemánticaDocument152 paginiDefinición de Un Catálogo de Servicios de Información Basados en La Web SemánticaCharo PradosÎncă nu există evaluări

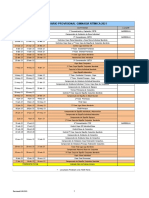

- Calendario Provisional GR 2021Document1 paginăCalendario Provisional GR 2021Charo PradosÎncă nu există evaluări

- Letras PuntocruzDocument28 paginiLetras PuntocruzCharo PradosÎncă nu există evaluări

- Práctica04 - Licitación de Un Procedimiento Licitación Con Negociación (Voluntaria)Document3 paginiPráctica04 - Licitación de Un Procedimiento Licitación Con Negociación (Voluntaria)Charo PradosÎncă nu există evaluări

- Modulo2 SeguridadSistemasInformaticosDocument30 paginiModulo2 SeguridadSistemasInformaticosCharo PradosÎncă nu există evaluări

- Modulo4 SeguridadSistemasInformaticosMay2015Document40 paginiModulo4 SeguridadSistemasInformaticosMay2015Charo PradosÎncă nu există evaluări

- NORMATIVA GENERAL FAG 2019 Con ModificacionesDocument19 paginiNORMATIVA GENERAL FAG 2019 Con ModificacionesCharo PradosÎncă nu există evaluări

- KegelDocument2 paginiKegelCharo PradosÎncă nu există evaluări

- Metodo de Los Minimos CuadradosDocument15 paginiMetodo de Los Minimos CuadradosMary Cruz BbmmÎncă nu există evaluări

- BibliografíaDocument29 paginiBibliografíacambyckÎncă nu există evaluări

- Annotated-Semana 3 - Hoja 1Document2 paginiAnnotated-Semana 3 - Hoja 1Sofia DepazÎncă nu există evaluări

- Capitulo 5: Analisis Estadistico Iv Sesión 1: Correlación y Regresión IIDocument35 paginiCapitulo 5: Analisis Estadistico Iv Sesión 1: Correlación y Regresión IILucio FernandoÎncă nu există evaluări

- Silabo Estadística y ProbabilidadesDocument6 paginiSilabo Estadística y ProbabilidadesEdward HVÎncă nu există evaluări

- EAURDocument472 paginiEAURloisÎncă nu există evaluări

- Analizis de Regresion Lineal Ejercicios 6 y 7Document6 paginiAnalizis de Regresion Lineal Ejercicios 6 y 7ChayaÎncă nu există evaluări

- Unidad 1-Estudio CostosDocument26 paginiUnidad 1-Estudio CostosPaúl OrellanaÎncă nu există evaluări

- Taller Costos IIIDocument17 paginiTaller Costos IIIAndrea PosadaÎncă nu există evaluări

- Regresion y Correlacion PDFDocument9 paginiRegresion y Correlacion PDFDana M. TÎncă nu există evaluări

- La Regresion LogisticaDocument8 paginiLa Regresion LogisticaFiorella Lizzeth GpÎncă nu există evaluări

- Metodos Numericos SumillaDocument6 paginiMetodos Numericos SumillaAndre CVÎncă nu există evaluări

- Funciones de Excel - EstadísticasDocument46 paginiFunciones de Excel - EstadísticasFabio CaldasÎncă nu există evaluări

- Paso 4Document14 paginiPaso 4Cristina MedinaÎncă nu există evaluări

- Ejemplo de Regresion Proyección DemandaDocument6 paginiEjemplo de Regresion Proyección DemandasergioÎncă nu există evaluări

- EVALUACIONDocument7 paginiEVALUACIONClaudiaÎncă nu există evaluări

- Supuesto Del Analisis FactorialDocument15 paginiSupuesto Del Analisis FactorialJohnny CHÎncă nu există evaluări

- 66 231 1 PBDocument9 pagini66 231 1 PBRodolfo CastañedaÎncă nu există evaluări

- EJERCICIO234Document9 paginiEJERCICIO234CaadasfaÎncă nu există evaluări

- Técnicas de Análisis de DatosDocument10 paginiTécnicas de Análisis de DatosJuanJoseAguilarPeña100% (1)

- Evaluacion - UNIDAD 2 - Regresión Lineal Simple y Teoría de La Probabilidad Calificacion 4.5 9 de 10Document8 paginiEvaluacion - UNIDAD 2 - Regresión Lineal Simple y Teoría de La Probabilidad Calificacion 4.5 9 de 10Carlos Eduardo CortésÎncă nu există evaluări

- 400-Texto Del Artículo-1444-1-10-20200730Document15 pagini400-Texto Del Artículo-1444-1-10-20200730Mary luz ChecaÎncă nu există evaluări

- Economía Empresarial PDFDocument36 paginiEconomía Empresarial PDFisrael rodriguezÎncă nu există evaluări

- Ayudantía Regresión - 02Document3 paginiAyudantía Regresión - 02Gabriela Alejandra ParraÎncă nu există evaluări

- Actividad 7-Modelo de RegresiónDocument11 paginiActividad 7-Modelo de RegresiónKatherine OrdoñezÎncă nu există evaluări

- Guía Breve de IBM SPSS Statistics 20Document183 paginiGuía Breve de IBM SPSS Statistics 20EliovirÎncă nu există evaluări

- Ejercicio 11.9Document11 paginiEjercicio 11.9Bianca IngaÎncă nu există evaluări

- Act MinitabDocument3 paginiAct MinitabCarlos Martinez alvaradoÎncă nu există evaluări

- Parcial Final Estadistica InferencialDocument14 paginiParcial Final Estadistica InferencialNere Niz ChavezÎncă nu există evaluări